TR-4965: iSCSI/ASM을 사용한 AWS FSx/EC2에서의 Oracle 데이터베이스 배포 및 보호

변경 제안

변경 제안

Allen Cao, Niyaz Mohamed, NetApp

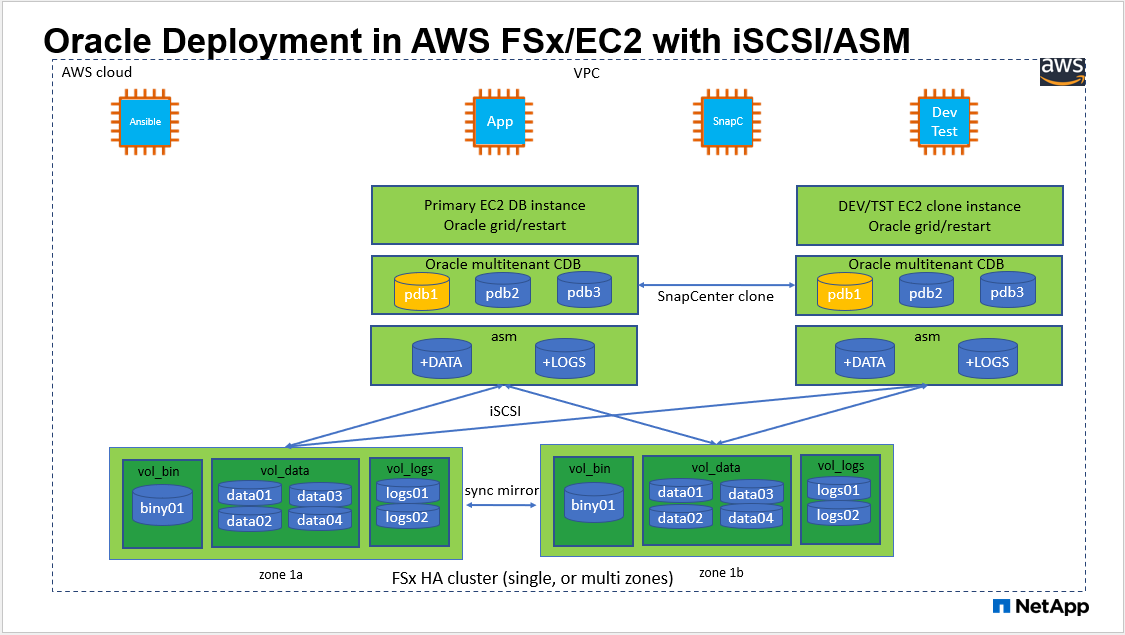

이 솔루션은 iSCSI 프로토콜과 asm을 볼륨 관리자로 사용하여 독립형 ReStart에서 구성된 Oracle 데이터베이스를 사용하여 AWS FSx ONTAP 스토리지와 EC2 컴퓨팅 인스턴스에서 Oracle 데이터베이스를 배포하고 보호하기 위한 개요와 세부 정보를 제공합니다.

목적

ASM(자동 스토리지 관리)은 많은 Oracle 설치에 사용되는 인기 있는 Oracle 스토리지 볼륨 관리자입니다. 이는 Oracle에서 권장하는 스토리지 관리 솔루션이기도 합니다. 기존 볼륨 관리자와 파일 시스템에 대한 대안을 제공합니다. Oracle 11g 버전부터 ASM은 데이터베이스가 아닌 그리드 인프라와 함께 패키징되었습니다. 따라서 RAC 없이 스토리지 관리를 위해 Oracle ASM을 활용하려면 Oracle Restart라고도 하는 독립형 서버에 Oracle Grid Infrastructure을 설치해야 합니다. 그렇게 하면 Oracle 데이터베이스 배포가 더 복잡해집니다. 하지만 이름에서 알 수 있듯이 Oracle을 재시작 모드로 배포하면 실패한 Oracle 서비스가 사용자 개입 없이 그리드 인프라에 의해 자동으로 재시작되거나 호스트가 재부팅된 후 다시 시작되어 일정 수준의 고가용성 또는 HA 기능을 제공합니다.

이 문서에서는 EC2 컴퓨팅 인스턴스가 있는 Amazon FSx ONTAP 스토리지 환경에서 iSCSI 프로토콜과 Oracle ASM을 사용하여 Oracle 데이터베이스를 배포하는 방법을 보여줍니다. 또한 NetApp BlueXP 콘솔을 통해 NetApp SnapCenter 서비스를 사용하여 AWS 퍼블릭 클라우드에서 저장 효율적인 데이터베이스 운영을 위한 개발/테스트 또는 기타 사용 사례를 위해 Oracle 데이터베이스를 백업, 복원 및 복제하는 방법을 보여드립니다.

이 솔루션은 다음과 같은 사용 사례를 해결합니다.

-

iSCSI/ASM을 사용한 Amazon FSx ONTAP 스토리지 및 EC2 컴퓨팅 인스턴스에 Oracle 데이터베이스 배포

-

iSCSI/ASM을 사용하여 퍼블릭 AWS 클라우드에서 Oracle 워크로드 테스트 및 검증

-

AWS에 배포된 Oracle 데이터베이스 재시작 기능 테스트 및 검증

대상

이 솔루션은 다음과 같은 사람들을 위해 만들어졌습니다.

-

iSCSI/ASM을 사용하여 AWS 퍼블릭 클라우드에 Oracle을 배포하려는 DBA입니다.

-

AWS 퍼블릭 클라우드에서 Oracle 워크로드를 테스트하려는 데이터베이스 솔루션 아키텍트입니다.

-

AWS FSx 스토리지에 배포된 Oracle 데이터베이스를 배포하고 관리하려는 스토리지 관리자입니다.

-

AWS FSx/EC2에 Oracle 데이터베이스를 구축하려는 애플리케이션 소유자입니다.

솔루션 테스트 및 검증 환경

이 솔루션의 테스트와 검증은 최종 배포 환경과 일치하지 않을 수 있는 AWS FSx 및 EC2 환경에서 수행되었습니다. 자세한 내용은 다음 섹션을 참조하세요. 배포 고려사항의 핵심 요소 .

아키텍처

하드웨어 및 소프트웨어 구성 요소

하드웨어 |

||

FSx ONTAP 스토리지 |

AWS에서 제공하는 현재 버전 |

동일한 VPC 및 가용성 영역에 있는 하나의 FSx HA 클러스터 |

컴퓨팅을 위한 EC2 인스턴스 |

t2.xlarge/4vCPU/16G |

두 개의 EC2 T2 xlarge EC2 인스턴스(하나는 기본 DB 서버로, 다른 하나는 복제 DB 서버로 사용) |

소프트웨어 |

||

레드햇 리눅스 |

RHEL-8.6.0_HVM-20220503-x86_64-2-시간별2-GP2 |

테스트를 위해 RedHat 구독을 배포했습니다. |

오라클 그리드 인프라 |

버전 19.18 |

RU 패치 p34762026_190000_Linux-x86-64.zip이 적용되었습니다. |

오라클 데이터베이스 |

버전 19.18 |

RU 패치 p34765931_190000_Linux-x86-64.zip을 적용했습니다. |

오라클 OPatch |

버전 12.2.0.1.36 |

최신 패치 p6880880_190000_Linux-x86-64.zip |

SnapCenter 서비스 |

버전 |

v2.3.1.2324 |

배포 고려사항의 핵심 요소

-

EC2 컴퓨팅 인스턴스. 이러한 테스트와 검증에서는 Oracle 데이터베이스 컴퓨팅 인스턴스에 AWS EC2 t2.xlarge 인스턴스 유형을 사용했습니다. NetApp 데이터베이스 워크로드에 최적화되어 있으므로 프로덕션 배포 시 Oracle의 컴퓨팅 인스턴스로 M5 유형 EC2 인스턴스를 사용할 것을 권장합니다. 실제 작업 부하 요구 사항에 따라 vCPU 수와 RAM 양에 맞게 EC2 인스턴스 크기를 적절히 조정해야 합니다.

-

FSx 스토리지 HA 클러스터 단일 또는 다중 영역 배포. 이러한 테스트와 검증을 통해 단일 AWS 가용성 영역에 FSx HA 클러스터를 배포했습니다. 프로덕션 배포의 경우 NetApp 두 개의 서로 다른 가용성 영역에 FSx HA 쌍을 배포할 것을 권장합니다. FSx HA 클러스터는 항상 스토리지 수준 중복성을 제공하기 위해 액티브-패시브 파일 시스템 쌍에 동기화 미러링된 HA 쌍으로 프로비저닝됩니다. 다중 영역 배포는 단일 AWS 영역에서 장애가 발생할 경우 고가용성을 더욱 향상시킵니다.

-

FSx 스토리지 클러스터 크기 조정. Amazon FSx ONTAP 스토리지 파일 시스템은 최대 160,000 원시 SSD IOPS, 최대 4GBps 처리량, 최대 192TiB 용량을 제공합니다. 그러나 배포 시점의 실제 요구 사항에 따라 프로비저닝된 IOPS, 처리량 및 저장 용량 한도(최소 1,024GiB)를 기준으로 클러스터 크기를 조정할 수 있습니다. 애플리케이션 가용성에 영향을 주지 않고 용량을 즉시 동적으로 조정할 수 있습니다.

-

Oracle 데이터 및 로그 레이아웃. 테스트와 검증 과정에서 데이터와 로그에 대해 각각 두 개의 ASM 디스크 그룹을 배포했습니다. +DATA asm 디스크 그룹 내에서 데이터 볼륨에 4개의 LUN을 프로비저닝했습니다. +LOGS asm 디스크 그룹 내에서 로그 볼륨에 두 개의 LUN을 프로비저닝했습니다. 일반적으로 Amazon FSx ONTAP 볼륨 내에 여러 LUN을 배치하면 더 나은 성능을 얻을 수 있습니다.

-

iSCSI 구성. EC2 인스턴스 데이터베이스 서버는 iSCSI 프로토콜을 통해 FSx 스토리지에 연결됩니다. EC2 인스턴스는 일반적으로 단일 네트워크 인터페이스 또는 ENI로 배포됩니다. 단일 NIC 인터페이스는 iSCSI와 애플리케이션 트래픽을 모두 전송합니다. 올바른 EC2 컴퓨팅 인스턴스를 선택하려면 Oracle AWR 보고서를 신중하게 분석하여 Oracle 데이터베이스의 최대 I/O 처리량 요구 사항을 측정하는 것이 중요합니다. 이를 통해 애플리케이션과 iSCSI 트래픽 처리량 요구 사항을 모두 충족합니다. NetApp 다중 경로가 올바르게 구성된 두 FSx iSCSI 엔드포인트에 4개의 iSCSI 연결을 할당할 것을 권장합니다.

-

사용자가 생성하는 각 Oracle ASM 디스크 그룹에 사용할 Oracle ASM 중복 수준입니다. FSx는 이미 FSx 클러스터 수준에서 스토리지를 미러링하므로 외부 중복성을 사용해야 합니다. 즉, 이 옵션을 사용하면 Oracle ASM이 디스크 그룹의 내용을 미러링할 수 없습니다.

-

데이터베이스 백업. NetApp NetApp BlueXP 콘솔 UI를 통해 사용할 수 있는 클라우드에서 데이터베이스 백업, 복원 및 복제를 위한 SnapCenter software 서비스의 SaaS 버전을 제공합니다. NetApp 빠른(1분 이내) 스냅샷 백업, 빠른(몇 분) 데이터베이스 복원 및 데이터베이스 복제를 달성하기 위해 이러한 서비스를 구현할 것을 권장합니다.

솔루션 구축

다음 섹션에서는 단계별 배포 절차를 제공합니다.

배포를 위한 전제 조건

Details

배포에는 다음과 같은 전제 조건이 필요합니다.

-

AWS 계정이 설정되었고, AWS 계정 내에 필요한 VPC 및 네트워크 세그먼트가 생성되었습니다.

-

AWS EC2 콘솔에서 두 개의 EC2 Linux 인스턴스를 배포해야 합니다. 하나는 기본 Oracle DB 서버로, 다른 하나는 선택적으로 대체 복제 대상 DB 서버로 배포합니다. 환경 설정에 대한 자세한 내용은 이전 섹션의 아키텍처 다이어그램을 참조하세요. 또한 검토하세요"Linux 인스턴스 사용자 가이드" 자세한 내용은.

-

AWS EC2 콘솔에서 Amazon FSx ONTAP 스토리지 HA 클러스터를 배포하여 Oracle 데이터베이스 볼륨을 호스팅합니다. FSx 스토리지 배포에 익숙하지 않은 경우 설명서를 참조하세요."FSx ONTAP 파일 시스템 생성" 단계별 지침을 확인하세요.

-

2단계와 3단계는 다음 Terraform 자동화 툴킷을 사용하여 수행할 수 있습니다. 이 툴킷은 다음과 같은 EC2 인스턴스를 생성합니다.

ora_01그리고 FSx 파일 시스템이라는 이름fsx_01. 지침을 주의 깊게 검토하고 실행하기 전에 환경에 맞게 변수를 변경하세요.git clone https://github.com/NetApp-Automation/na_aws_fsx_ec2_deploy.git

|

Oracle 설치 파일을 준비할 충분한 공간을 확보하려면 EC2 인스턴스 루트 볼륨에 최소 50G를 할당했는지 확인하세요. |

EC2 인스턴스 커널 구성

Details

필수 구성 요소가 프로비저닝되면 ec2-user로 EC2 인스턴스에 로그인하고 루트 사용자로 sudo를 실행하여 Oracle 설치를 위한 Linux 커널을 구성합니다.

-

스테이징 디렉토리 만들기

/tmp/archive폴더와 설정777허가.mkdir /tmp/archive chmod 777 /tmp/archive

-

Oracle 바이너리 설치 파일 및 기타 필수 rpm 파일을 다운로드하고 준비합니다.

/tmp/archive예배 규칙서.다음 설치 파일 목록을 참조하세요.

/tmp/archiveEC2 인스턴스에서.[ec2-user@ip-172-30-15-58 ~]$ ls -l /tmp/archive total 10537316 -rw-rw-r--. 1 ec2-user ec2-user 19112 Mar 21 15:57 compat-libcap1-1.10-7.el7.x86_64.rpm -rw-rw-r-- 1 ec2-user ec2-user 3059705302 Mar 21 22:01 LINUX.X64_193000_db_home.zip -rw-rw-r-- 1 ec2-user ec2-user 2889184573 Mar 21 21:09 LINUX.X64_193000_grid_home.zip -rw-rw-r--. 1 ec2-user ec2-user 589145 Mar 21 15:56 netapp_linux_unified_host_utilities-7-1.x86_64.rpm -rw-rw-r--. 1 ec2-user ec2-user 31828 Mar 21 15:55 oracle-database-preinstall-19c-1.0-2.el8.x86_64.rpm -rw-rw-r-- 1 ec2-user ec2-user 2872741741 Mar 21 22:31 p34762026_190000_Linux-x86-64.zip -rw-rw-r-- 1 ec2-user ec2-user 1843577895 Mar 21 22:32 p34765931_190000_Linux-x86-64.zip -rw-rw-r-- 1 ec2-user ec2-user 124347218 Mar 21 22:33 p6880880_190000_Linux-x86-64.zip -rw-r--r-- 1 ec2-user ec2-user 257136 Mar 22 16:25 policycoreutils-python-utils-2.9-9.el8.noarch.rpm

-

대부분의 커널 구성 요구 사항을 충족하는 Oracle 19c 사전 설치 RPM을 설치합니다.

yum install /tmp/archive/oracle-database-preinstall-19c-1.0-2.el8.x86_64.rpm

-

누락된 것을 다운로드하고 설치하세요

compat-libcap1리눅스 8에서.yum install /tmp/archive/compat-libcap1-1.10-7.el7.x86_64.rpm

-

NetApp 에서 NetApp 호스트 유틸리티를 다운로드하여 설치합니다.

yum install /tmp/archive/netapp_linux_unified_host_utilities-7-1.x86_64.rpm

-

설치하다

policycoreutils-python-utilsEC2 인스턴스에서는 사용할 수 없습니다.yum install /tmp/archive/policycoreutils-python-utils-2.9-9.el8.noarch.rpm

-

Open JDK 버전 1.8을 설치합니다.

yum install java-1.8.0-openjdk.x86_64

-

iSCSI 이니시에이터 유틸리티를 설치합니다.

yum install iscsi-initiator-utils

-

설치하다

sg3_utils.yum install sg3_utils

-

설치하다

device-mapper-multipath.yum install device-mapper-multipath

-

현재 시스템에서 투명한 거대 페이지를 비활성화합니다.

echo never > /sys/kernel/mm/transparent_hugepage/enabled echo never > /sys/kernel/mm/transparent_hugepage/defrag

다음 줄을 추가하세요

/etc/rc.local비활성화하다transparent_hugepage재부팅 후:# Disable transparent hugepages if test -f /sys/kernel/mm/transparent_hugepage/enabled; then echo never > /sys/kernel/mm/transparent_hugepage/enabled fi if test -f /sys/kernel/mm/transparent_hugepage/defrag; then echo never > /sys/kernel/mm/transparent_hugepage/defrag fi -

변경하여 selinux를 비활성화하세요

SELINUX=enforcing에게SELINUX=disabled. 변경 사항을 적용하려면 호스트를 재부팅해야 합니다.vi /etc/sysconfig/selinux

-

다음 줄을 추가하세요

limit.conf따옴표 없이 파일 설명자 제한 및 스택 크기를 설정하려면" ".vi /etc/security/limits.conf "* hard nofile 65536" "* soft stack 10240"

-

다음 지침에 따라 EC2 인스턴스에 스왑 공간을 추가하세요."스왑 파일을 사용하여 Amazon EC2 인스턴스에서 스왑 공간으로 작동하는 메모리를 할당하려면 어떻게 해야 합니까?" 추가할 수 있는 정확한 공간의 양은 최대 16G까지의 RAM 크기에 따라 달라집니다.

-

변화

node.session.timeo.replacement_timeout에서iscsi.conf구성 파일을 120초에서 5초로 줄였습니다.vi /etc/iscsi/iscsid.conf

-

EC2 인스턴스에서 iSCSI 서비스를 활성화하고 시작합니다.

systemctl enable iscsid systemctl start iscsid

-

데이터베이스 LUN 매핑에 사용할 iSCSI 초기자 주소를 검색합니다.

cat /etc/iscsi/initiatorname.iscsi

-

asm sysasm 그룹에 사용할 ASM 그룹을 추가합니다.

groupadd asm

-

ASM을 보조 그룹으로 추가하기 위해 oracle 사용자를 수정합니다(oracle 사용자는 Oracle 사전 설치 RPM 설치 후에 생성되어야 합니다).

usermod -a -G asm oracle

-

Linux 방화벽이 활성화되어 있으면 중지하고 비활성화합니다.

systemctl stop firewalld systemctl disable firewalld

-

EC2 인스턴스를 재부팅합니다.

EC2 인스턴스 호스트에 데이터베이스 볼륨 및 LUN을 프로비저닝하고 매핑합니다.

Details

FSx 클러스터 관리 IP를 사용하여 fsxadmin 사용자로 ssh를 통해 FSx 클러스터에 로그인하여 명령줄에서 세 개의 볼륨을 프로비저닝하고 Oracle 데이터베이스 바이너리, 데이터 및 로그 파일을 호스팅합니다.

-

fsxadmin 사용자로 SSH를 통해 FSx 클러스터에 로그인합니다.

ssh fsxadmin@172.30.15.53

-

다음 명령을 실행하여 Oracle 바이너리에 대한 볼륨을 생성합니다.

vol create -volume ora_01_biny -aggregate aggr1 -size 50G -state online -type RW -snapshot-policy none -tiering-policy snapshot-only

-

Oracle 데이터에 대한 볼륨을 생성하려면 다음 명령을 실행하세요.

vol create -volume ora_01_data -aggregate aggr1 -size 100G -state online -type RW -snapshot-policy none -tiering-policy snapshot-only

-

다음 명령을 실행하여 Oracle 로그에 대한 볼륨을 생성합니다.

vol create -volume ora_01_logs -aggregate aggr1 -size 100G -state online -type RW -snapshot-policy none -tiering-policy snapshot-only

-

데이터베이스 바이너리 볼륨 내에 바이너리 LUN을 생성합니다.

lun create -path /vol/ora_01_biny/ora_01_biny_01 -size 40G -ostype linux

-

데이터베이스 데이터 볼륨 내에 데이터 LUN을 생성합니다.

lun create -path /vol/ora_01_data/ora_01_data_01 -size 20G -ostype linux lun create -path /vol/ora_01_data/ora_01_data_02 -size 20G -ostype linux lun create -path /vol/ora_01_data/ora_01_data_03 -size 20G -ostype linux lun create -path /vol/ora_01_data/ora_01_data_04 -size 20G -ostype linux

-

데이터베이스 로그 볼륨 내에 로그 LUN을 생성합니다.

lun create -path /vol/ora_01_logs/ora_01_logs_01 -size 40G -ostype linux lun create -path /vol/ora_01_logs/ora_01_logs_02 -size 40G -ostype linux

-

위의 EC2 커널 구성의 14단계에서 검색된 개시자로 EC2 인스턴스에 대한 igroup을 만듭니다.

igroup create -igroup ora_01 -protocol iscsi -ostype linux -initiator iqn.1994-05.com.redhat:f65fed7641c2

-

위에서 생성한 igroup에 LUN을 매핑합니다. 볼륨 내의 각 추가 LUN에 대해 LUN ID를 순차적으로 증가시킵니다.

lun map -path /vol/ora_01_biny/ora_01_biny_01 -igroup ora_01 -vserver svm_ora -lun-id 0 lun map -path /vol/ora_01_data/ora_01_data_01 -igroup ora_01 -vserver svm_ora -lun-id 1 lun map -path /vol/ora_01_data/ora_01_data_02 -igroup ora_01 -vserver svm_ora -lun-id 2 lun map -path /vol/ora_01_data/ora_01_data_03 -igroup ora_01 -vserver svm_ora -lun-id 3 lun map -path /vol/ora_01_data/ora_01_data_04 -igroup ora_01 -vserver svm_ora -lun-id 4 lun map -path /vol/ora_01_logs/ora_01_logs_01 -igroup ora_01 -vserver svm_ora -lun-id 5 lun map -path /vol/ora_01_logs/ora_01_logs_02 -igroup ora_01 -vserver svm_ora -lun-id 6

-

LUN 매핑을 검증합니다.

mapping show

다음이 반환될 것으로 예상됩니다.

FsxId02ad7bf3476b741df::> mapping show (lun mapping show) Vserver Path Igroup LUN ID Protocol ---------- ---------------------------------------- ------- ------ -------- svm_ora /vol/ora_01_biny/ora_01_biny_01 ora_01 0 iscsi svm_ora /vol/ora_01_data/ora_01_data_01 ora_01 1 iscsi svm_ora /vol/ora_01_data/ora_01_data_02 ora_01 2 iscsi svm_ora /vol/ora_01_data/ora_01_data_03 ora_01 3 iscsi svm_ora /vol/ora_01_data/ora_01_data_04 ora_01 4 iscsi svm_ora /vol/ora_01_logs/ora_01_logs_01 ora_01 5 iscsi svm_ora /vol/ora_01_logs/ora_01_logs_02 ora_01 6 iscsi

데이터베이스 저장소 구성

Details

이제 EC2 인스턴스 호스트에 Oracle 그리드 인프라와 데이터베이스 설치를 위한 FSx 스토리지를 가져와 설정합니다.

-

SSH 키와 EC2 인스턴스 IP 주소를 사용하여 ec2-user로 SSH를 통해 EC2 인스턴스에 로그인합니다.

ssh -i ora_01.pem ec2-user@172.30.15.58

-

SVM iSCSI IP 주소를 사용하여 FSx iSCSI 엔드포인트를 검색합니다. 그런 다음 환경에 맞는 포털 주소로 변경하세요.

sudo iscsiadm iscsiadm --mode discovery --op update --type sendtargets --portal 172.30.15.51

-

각 대상에 로그인하여 iSCSI 세션을 설정합니다.

sudo iscsiadm --mode node -l all

이 명령의 예상 출력은 다음과 같습니다.

[ec2-user@ip-172-30-15-58 ~]$ sudo iscsiadm --mode node -l all Logging in to [iface: default, target: iqn.1992-08.com.netapp:sn.1f795e65c74911edb785affbf0a2b26e:vs.3, portal: 172.30.15.51,3260] Logging in to [iface: default, target: iqn.1992-08.com.netapp:sn.1f795e65c74911edb785affbf0a2b26e:vs.3, portal: 172.30.15.13,3260] Login to [iface: default, target: iqn.1992-08.com.netapp:sn.1f795e65c74911edb785affbf0a2b26e:vs.3, portal: 172.30.15.51,3260] successful. Login to [iface: default, target: iqn.1992-08.com.netapp:sn.1f795e65c74911edb785affbf0a2b26e:vs.3, portal: 172.30.15.13,3260] successful.

-

활성 iSCSI 세션 목록을 보고 확인합니다.

sudo iscsiadm --mode session

iSCSI 세션을 반환합니다.

[ec2-user@ip-172-30-15-58 ~]$ sudo iscsiadm --mode session tcp: [1] 172.30.15.51:3260,1028 iqn.1992-08.com.netapp:sn.1f795e65c74911edb785affbf0a2b26e:vs.3 (non-flash) tcp: [2] 172.30.15.13:3260,1029 iqn.1992-08.com.netapp:sn.1f795e65c74911edb785affbf0a2b26e:vs.3 (non-flash)

-

LUN이 호스트로 가져왔는지 확인하세요.

sudo sanlun lun show

이렇게 하면 FSx에서 Oracle LUN 목록이 반환됩니다.

[ec2-user@ip-172-30-15-58 ~]$ sudo sanlun lun show controller(7mode/E-Series)/ device host lun vserver(cDOT/FlashRay) lun-pathname filename adapter protocol size product svm_ora /vol/ora_01_logs/ora_01_logs_02 /dev/sdn host3 iSCSI 40g cDOT svm_ora /vol/ora_01_logs/ora_01_logs_01 /dev/sdm host3 iSCSI 40g cDOT svm_ora /vol/ora_01_data/ora_01_data_03 /dev/sdk host3 iSCSI 20g cDOT svm_ora /vol/ora_01_data/ora_01_data_04 /dev/sdl host3 iSCSI 20g cDOT svm_ora /vol/ora_01_data/ora_01_data_01 /dev/sdi host3 iSCSI 20g cDOT svm_ora /vol/ora_01_data/ora_01_data_02 /dev/sdj host3 iSCSI 20g cDOT svm_ora /vol/ora_01_biny/ora_01_biny_01 /dev/sdh host3 iSCSI 40g cDOT svm_ora /vol/ora_01_logs/ora_01_logs_02 /dev/sdg host2 iSCSI 40g cDOT svm_ora /vol/ora_01_logs/ora_01_logs_01 /dev/sdf host2 iSCSI 40g cDOT svm_ora /vol/ora_01_data/ora_01_data_04 /dev/sde host2 iSCSI 20g cDOT svm_ora /vol/ora_01_data/ora_01_data_02 /dev/sdc host2 iSCSI 20g cDOT svm_ora /vol/ora_01_data/ora_01_data_03 /dev/sdd host2 iSCSI 20g cDOT svm_ora /vol/ora_01_data/ora_01_data_01 /dev/sdb host2 iSCSI 20g cDOT svm_ora /vol/ora_01_biny/ora_01_biny_01 /dev/sda host2 iSCSI 40g cDOT

-

구성하다

multipath.conf다음 기본 및 블랙리스트 항목이 포함된 파일입니다.sudo vi /etc/multipath.conf defaults { find_multipaths yes user_friendly_names yes } blacklist { devnode "^(ram|raw|loop|fd|md|dm-|sr|scd|st)[0-9]*" devnode "^hd[a-z]" devnode "^cciss.*" } -

멀티패스 서비스를 시작합니다.

sudo systemctl start multipathd

이제 다중 경로 장치가 나타납니다.

/dev/mapper예배 규칙서.[ec2-user@ip-172-30-15-58 ~]$ ls -l /dev/mapper total 0 lrwxrwxrwx 1 root root 7 Mar 21 20:13 3600a09806c574235472455534e68512d -> ../dm-0 lrwxrwxrwx 1 root root 7 Mar 21 20:13 3600a09806c574235472455534e685141 -> ../dm-1 lrwxrwxrwx 1 root root 7 Mar 21 20:13 3600a09806c574235472455534e685142 -> ../dm-2 lrwxrwxrwx 1 root root 7 Mar 21 20:13 3600a09806c574235472455534e685143 -> ../dm-3 lrwxrwxrwx 1 root root 7 Mar 21 20:13 3600a09806c574235472455534e685144 -> ../dm-4 lrwxrwxrwx 1 root root 7 Mar 21 20:13 3600a09806c574235472455534e685145 -> ../dm-5 lrwxrwxrwx 1 root root 7 Mar 21 20:13 3600a09806c574235472455534e685146 -> ../dm-6 crw------- 1 root root 10, 236 Mar 21 18:19 control

-

SSH를 통해 fsxadmin 사용자로 FSx 클러스터에 로그인하여 6c574xxx…로 시작하는 각 LUN의 일련 16진수 번호를 검색합니다. 이 16진수 번호는 3600a0980으로 시작하는데, 이는 AWS 공급업체 ID입니다.

lun show -fields serial-hex

다음과 같이 반환합니다.

FsxId02ad7bf3476b741df::> lun show -fields serial-hex vserver path serial-hex ------- ------------------------------- ------------------------ svm_ora /vol/ora_01_biny/ora_01_biny_01 6c574235472455534e68512d svm_ora /vol/ora_01_data/ora_01_data_01 6c574235472455534e685141 svm_ora /vol/ora_01_data/ora_01_data_02 6c574235472455534e685142 svm_ora /vol/ora_01_data/ora_01_data_03 6c574235472455534e685143 svm_ora /vol/ora_01_data/ora_01_data_04 6c574235472455534e685144 svm_ora /vol/ora_01_logs/ora_01_logs_01 6c574235472455534e685145 svm_ora /vol/ora_01_logs/ora_01_logs_02 6c574235472455534e685146 7 entries were displayed.

-

업데이트

/dev/multipath.conf다중 경로 장치에 사용자 친화적인 이름을 추가하는 파일입니다.sudo vi /etc/multipath.conf

다음 항목이 포함되어 있습니다:

multipaths { multipath { wwid 3600a09806c574235472455534e68512d alias ora_01_biny_01 } multipath { wwid 3600a09806c574235472455534e685141 alias ora_01_data_01 } multipath { wwid 3600a09806c574235472455534e685142 alias ora_01_data_02 } multipath { wwid 3600a09806c574235472455534e685143 alias ora_01_data_03 } multipath { wwid 3600a09806c574235472455534e685144 alias ora_01_data_04 } multipath { wwid 3600a09806c574235472455534e685145 alias ora_01_logs_01 } multipath { wwid 3600a09806c574235472455534e685146 alias ora_01_logs_02 } } -

장치가 다음 위치에 있는지 확인하려면 다중 경로 서비스를 재부팅하세요.

/dev/mapperLUN 이름이 직렬 16진수 ID로 변경되었습니다.sudo systemctl restart multipathd

확인하다

/dev/mapper다음과 같이 반환됩니다.[ec2-user@ip-172-30-15-58 ~]$ ls -l /dev/mapper total 0 crw------- 1 root root 10, 236 Mar 21 18:19 control lrwxrwxrwx 1 root root 7 Mar 21 20:41 ora_01_biny_01 -> ../dm-0 lrwxrwxrwx 1 root root 7 Mar 21 20:41 ora_01_data_01 -> ../dm-1 lrwxrwxrwx 1 root root 7 Mar 21 20:41 ora_01_data_02 -> ../dm-2 lrwxrwxrwx 1 root root 7 Mar 21 20:41 ora_01_data_03 -> ../dm-3 lrwxrwxrwx 1 root root 7 Mar 21 20:41 ora_01_data_04 -> ../dm-4 lrwxrwxrwx 1 root root 7 Mar 21 20:41 ora_01_logs_01 -> ../dm-5 lrwxrwxrwx 1 root root 7 Mar 21 20:41 ora_01_logs_02 -> ../dm-6

-

이진 LUN을 단일 기본 파티션으로 분할합니다.

sudo fdisk /dev/mapper/ora_01_biny_01

-

분할된 바이너리 LUN을 XFS 파일 시스템으로 포맷합니다.

sudo mkfs.xfs /dev/mapper/ora_01_biny_01p1

-

바이너리 LUN을 마운트합니다.

/u01.sudo mount -t xfs /dev/mapper/ora_01_biny_01p1 /u01

-

변화

/u01마운트 지점 소유권은 Oracle 사용자와 연관된 기본 그룹에 있습니다.sudo chown oracle:oinstall /u01

-

이진 LUN의 UUI를 찾으세요.

sudo blkid /dev/mapper/ora_01_biny_01p1

-

마운트 지점을 추가하세요

/etc/fstab.sudo vi /etc/fstab

다음 줄을 추가합니다.

UUID=d89fb1c9-4f89-4de4-b4d9-17754036d11d /u01 xfs defaults,nofail 0 2

EC2 인스턴스 재부팅 시 루트 잠금 문제가 발생하지 않도록 하려면 UUID만 사용하고 nofail 옵션을 사용하여 바이너리를 마운트하는 것이 중요합니다. -

루트 사용자로 Oracle 장치에 대한 udev 규칙을 추가합니다.

vi /etc/udev/rules.d/99-oracle-asmdevices.rules

다음 항목을 포함합니다.

ENV{DM_NAME}=="ora*", GROUP:="oinstall", OWNER:="oracle", MODE:="660" -

루트 사용자로 udev 규칙을 다시 로드합니다.

udevadm control --reload-rules

-

루트 사용자로서 udev 규칙을 트리거합니다.

udevadm trigger

-

루트 사용자로 multipathd를 다시 로드합니다.

systemctl restart multipathd

-

EC2 인스턴스 호스트를 재부팅합니다.

Oracle 그리드 인프라 설치

Details

-

SSH를 통해 ec2-user로 EC2 인스턴스에 로그인하고 주석 처리를 제거하여 암호 인증을 활성화합니다.

PasswordAuthentication yes그리고 나서 주석을 달다PasswordAuthentication no.sudo vi /etc/ssh/sshd_config

-

sshd 서비스를 다시 시작합니다.

sudo systemctl restart sshd

-

Oracle 사용자 비밀번호를 재설정합니다.

sudo passwd oracle

-

Oracle Restart 소프트웨어 소유자 사용자(oracle)로 로그인합니다. 다음과 같이 Oracle 디렉토리를 만듭니다.

mkdir -p /u01/app/oracle mkdir -p /u01/app/oraInventory

-

디렉토리 권한 설정을 변경합니다.

chmod -R 775 /u01/app

-

그리드 홈 디렉토리를 만들고 변경합니다.

mkdir -p /u01/app/oracle/product/19.0.0/grid cd /u01/app/oracle/product/19.0.0/grid

-

그리드 설치 파일의 압축을 풉니다.

unzip -q /tmp/archive/LINUX.X64_193000_grid_home.zip

-

그리드 홈에서 삭제

OPatch예배 규칙서.rm -rf OPatch

-

그리드 홈에서 압축 해제

p6880880_190000_Linux-x86-64.zip.unzip -q /tmp/archive/p6880880_190000_Linux-x86-64.zip

-

그리드 홈에서 수정

cv/admin/cvu_config, 주석을 제거하고 교체합니다.CV_ASSUME_DISTID=OEL5~와 함께CV_ASSUME_DISTID=OL7.vi cv/admin/cvu_config

-

업데이트

gridsetup.rsp자동 설치를 위한 파일을 만들고 rsp 파일을 다음 위치에 두십시오./tmp/archive예배 규칙서. rsp 파일에는 다음 정보와 함께 A, B, G 섹션이 포함되어야 합니다.INVENTORY_LOCATION=/u01/app/oraInventory oracle.install.option=HA_CONFIG ORACLE_BASE=/u01/app/oracle oracle.install.asm.OSDBA=dba oracle.install.asm.OSOPER=oper oracle.install.asm.OSASM=asm oracle.install.asm.SYSASMPassword="SetPWD" oracle.install.asm.diskGroup.name=DATA oracle.install.asm.diskGroup.redundancy=EXTERNAL oracle.install.asm.diskGroup.AUSize=4 oracle.install.asm.diskGroup.disks=/dev/mapper/ora_01_data_01,/dev/mapper/ora_01_data_02,/dev/mapper/ora_01_data_03,/dev/mapper/ora_01_data_04 oracle.install.asm.diskGroup.diskDiscoveryString=/dev/mapper/* oracle.install.asm.monitorPassword="SetPWD" oracle.install.asm.configureAFD=true

-

EC2 인스턴스에 루트 사용자로 로그인하고 설정하세요.

ORACLE_HOME그리고ORACLE_BASE.export ORACLE_HOME=/u01/app/oracle/product/19.0.0/grid export ORACLE_BASE=/tmp cd /u01/app/oracle/product/19.0.0/grid/bin

-

Oracle ASM 필터 드라이버와 함께 사용할 디스크 장치를 프로비저닝합니다.

./asmcmd afd_label DATA01 /dev/mapper/ora_01_data_01 --init ./asmcmd afd_label DATA02 /dev/mapper/ora_01_data_02 --init ./asmcmd afd_label DATA03 /dev/mapper/ora_01_data_03 --init ./asmcmd afd_label DATA04 /dev/mapper/ora_01_data_04 --init ./asmcmd afd_label LOGS01 /dev/mapper/ora_01_logs_01 --init ./asmcmd afd_label LOGS02 /dev/mapper/ora_01_logs_02 --init

-

설치하다

cvuqdisk-1.0.10-1.rpm.rpm -ivh /u01/app/oracle/product/19.0.0/grid/cv/rpm/cvuqdisk-1.0.10-1.rpm

-

설정되지 않음

$ORACLE_BASE.unset ORACLE_BASE

-

Oracle 사용자로 EC2 인스턴스에 로그인하고 패치를 추출합니다.

/tmp/archive접는 사람.unzip /tmp/archive/p34762026_190000_Linux-x86-64.zip -d /tmp/archive

-

그리드 홈 /u01/app/oracle/product/19.0.0/grid에서 Oracle 사용자로 시작합니다.

gridSetup.sh그리드 인프라 설치를 위해../gridSetup.sh -applyRU /tmp/archive/34762026/ -silent -responseFile /tmp/archive/gridsetup.rsp

그리드 인프라에 잘못된 그룹이 있다는 경고는 무시하세요. Oracle Restart를 관리하기 위해 단일 Oracle 사용자를 사용하고 있으므로 이는 예상된 일입니다.

-

루트 사용자로 다음 스크립트를 실행합니다.

/u01/app/oraInventory/orainstRoot.sh /u01/app/oracle/product/19.0.0/grid/root.sh

-

루트 사용자로 multipathd를 다시 로드합니다.

systemctl restart multipathd

-

Oracle 사용자로서 다음 명령을 실행하여 구성을 완료합니다.

/u01/app/oracle/product/19.0.0/grid/gridSetup.sh -executeConfigTools -responseFile /tmp/archive/gridsetup.rsp -silent

-

Oracle 사용자로 $GRID_HOME에서 LOGS 디스크 그룹을 만듭니다.

bin/asmca -silent -sysAsmPassword 'yourPWD' -asmsnmpPassword 'yourPWD' -createDiskGroup -diskGroupName LOGS -disk 'AFD:LOGS*' -redundancy EXTERNAL -au_size 4

-

Oracle 사용자로서 설치 구성 후 그리드 서비스를 검증합니다.

bin/crsctl stat res -t + Name Target State Server State details Local Resources ora.DATA.dg ONLINE ONLINE ip-172-30-15-58 STABLE ora.LISTENER.lsnr ONLINE ONLINE ip-172-30-15-58 STABLE ora.LOGS.dg ONLINE ONLINE ip-172-30-15-58 STABLE ora.asm ONLINE ONLINE ip-172-30-15-58 Started,STABLE ora.ons OFFLINE OFFLINE ip-172-30-15-58 STABLE Cluster Resources ora.cssd ONLINE ONLINE ip-172-30-15-58 STABLE ora.diskmon OFFLINE OFFLINE STABLE ora.driver.afd ONLINE ONLINE ip-172-30-15-58 STABLE ora.evmd ONLINE ONLINE ip-172-30-15-58 STABLE

-

ASM 필터 드라이버 상태를 확인합니다.

[oracle@ip-172-30-15-58 grid]$ export ORACLE_HOME=/u01/app/oracle/product/19.0.0/grid [oracle@ip-172-30-15-58 grid]$ export ORACLE_SID=+ASM [oracle@ip-172-30-15-58 grid]$ export PATH=$PATH:$ORACLE_HOME/bin [oracle@ip-172-30-15-58 grid]$ asmcmd ASMCMD> lsdg State Type Rebal Sector Logical_Sector Block AU Total_MB Free_MB Req_mir_free_MB Usable_file_MB Offline_disks Voting_files Name MOUNTED EXTERN N 512 512 4096 1048576 81920 81847 0 81847 0 N DATA/ MOUNTED EXTERN N 512 512 4096 1048576 81920 81853 0 81853 0 N LOGS/ ASMCMD> afd_state ASMCMD-9526: The AFD state is 'LOADED' and filtering is 'ENABLED' on host 'ip-172-30-15-58.ec2.internal'

오라클 데이터베이스 설치

Details

-

Oracle 사용자로 로그인하고 설정을 해제합니다.

$ORACLE_HOME그리고$ORACLE_SID설정되어 있는 경우.unset ORACLE_HOME unset ORACLE_SID

-

Oracle DB 홈 디렉토리를 만들고 변경합니다.

mkdir /u01/app/oracle/product/19.0.0/db1 cd /u01/app/oracle/product/19.0.0/db1

-

Oracle DB 설치 파일의 압축을 풉니다.

unzip -q /tmp/archive/LINUX.X64_193000_db_home.zip

-

DB 홈에서 삭제하세요

OPatch예배 규칙서.rm -rf OPatch

-

DB 홈에서 압축을 풀어주세요

p6880880_190000_Linux-x86-64.zip.unzip -q /tmp/archive/p6880880_190000_Linux-x86-64.zip

-

DB홈에서 수정하세요

cv/admin/cvu_config, 주석을 제거하고 교체합니다.CV_ASSUME_DISTID=OEL5~와 함께CV_ASSUME_DISTID=OL7.vi cv/admin/cvu_config

-

에서

/tmp/archive디렉토리에서 DB 19.18 RU 패치를 압축 해제합니다.unzip p34765931_190000_Linux-x86-64.zip

-

DB 자동 설치 표준 rsp 파일을 업데이트합니다.

/tmp/archive/dbinstall.rsp다음 값을 해당 섹션에 포함하는 디렉토리:oracle.install.option=INSTALL_DB_SWONLY UNIX_GROUP_NAME=oinstall INVENTORY_LOCATION=/u01/app/oraInventory ORACLE_HOME=/u01/app/oracle/product/19.0.0/db1 ORACLE_BASE=/u01/app/oracle oracle.install.db.InstallEdition=EE oracle.install.db.OSDBA_GROUP=dba oracle.install.db.OSOPER_GROUP=oper oracle.install.db.OSBACKUPDBA_GROUP=oper oracle.install.db.OSDGDBA_GROUP=dba oracle.install.db.OSKMDBA_GROUP=dba oracle.install.db.OSRACDBA_GROUP=dba oracle.install.db.rootconfig.executeRootScript=false

-

db1 home /u01/app/oracle/product/19.0.0/db1에서 소프트웨어 전용 DB 설치를 실행합니다.

./runInstaller -applyRU /tmp/archive/34765931/ -silent -ignorePrereqFailure -responseFile /tmp/archive/dbinstall.rsp

-

루트 사용자로 다음을 실행합니다.

root.sh소프트웨어만 설치한 후의 스크립트입니다./u01/app/oracle/product/19.0.0/db1/root.sh

-

Oracle 사용자로서 표준을 업데이트하세요

dbca.rsp해당 섹션에 다음 항목이 포함된 파일:gdbName=db1.demo.netapp.com sid=db1 createAsContainerDatabase=true numberOfPDBs=3 pdbName=db1_pdb useLocalUndoForPDBs=true pdbAdminPassword="yourPWD" templateName=General_Purpose.dbc sysPassword="yourPWD" systemPassword="yourPWD" dbsnmpPassword="yourPWD" datafileDestination=+DATA recoveryAreaDestination=+LOGS storageType=ASM diskGroupName=DATA characterSet=AL32UTF8 nationalCharacterSet=AL16UTF16 listeners=LISTENER databaseType=MULTIPURPOSE automaticMemoryManagement=false totalMemory=8192

-

Oracle 사용자로서 $ORACLE_HOME 디렉토리에서 dbca를 사용하여 DB 생성을 시작합니다.

bin/dbca -silent -createDatabase -responseFile /tmp/archive/dbca.rsp output: Prepare for db operation 7% complete Registering database with Oracle Restart 11% complete Copying database files 33% complete Creating and starting Oracle instance 35% complete 38% complete 42% complete 45% complete 48% complete Completing Database Creation 53% complete 55% complete 56% complete Creating Pluggable Databases 60% complete 64% complete 69% complete 78% complete Executing Post Configuration Actions 100% complete Database creation complete. For details check the logfiles at: /u01/app/oracle/cfgtoollogs/dbca/db1. Database Information: Global Database Name:db1.demo.netapp.com System Identifier(SID):db1 Look at the log file "/u01/app/oracle/cfgtoollogs/dbca/db1/db1.log" for further details.

-

Oracle 사용자로서 DB 생성 후 Oracle Restart HA 서비스를 검증합니다.

[oracle@ip-172-30-15-58 db1]$ ../grid/bin/crsctl stat res -t Name Target State Server State details Local Resources ora.DATA.dg ONLINE ONLINE ip-172-30-15-58 STABLE ora.LISTENER.lsnr ONLINE ONLINE ip-172-30-15-58 STABLE ora.LOGS.dg ONLINE ONLINE ip-172-30-15-58 STABLE ora.asm ONLINE ONLINE ip-172-30-15-58 Started,STABLE ora.ons OFFLINE OFFLINE ip-172-30-15-58 STABLE Cluster Resources ora.cssd ONLINE ONLINE ip-172-30-15-58 STABLE ora.db1.db ONLINE ONLINE ip-172-30-15-58 Open,HOME=/u01/app/oracle/product/19.0.0/db1,STABLE ora.diskmon OFFLINE OFFLINE STABLE ora.driver.afd ONLINE ONLINE ip-172-30-15-58 STABLE ora.evmd ONLINE ONLINE ip-172-30-15-58 STABLE

-

Oracle 사용자 설정

.bash_profile.vi ~/.bash_profile

-

다음 항목을 추가합니다.

export ORACLE_HOME=/u01/app/oracle/product/19.0.0/db1 export ORACLE_SID=db1 export PATH=$PATH:$ORACLE_HOME/bin alias asm='export ORACLE_HOME=/u01/app/oracle/product/19.0.0/grid;export ORACLE_SID=+ASM;export PATH=$PATH:$ORACLE_HOME/bin'

-

생성된 CDB/PDB를 검증합니다.

source /home/oracle/.bash_profile sqlplus / as sysdba SQL> select name, open_mode from v$database; NAME OPEN_MODE DB1 READ WRITE SQL> select name from v$datafile; NAME +DATA/DB1/DATAFILE/system.256.1132176177 +DATA/DB1/DATAFILE/sysaux.257.1132176221 +DATA/DB1/DATAFILE/undotbs1.258.1132176247 +DATA/DB1/86B637B62FE07A65E053F706E80A27CA/DATAFILE/system.265.1132177009 +DATA/DB1/86B637B62FE07A65E053F706E80A27CA/DATAFILE/sysaux.266.1132177009 +DATA/DB1/DATAFILE/users.259.1132176247 +DATA/DB1/86B637B62FE07A65E053F706E80A27CA/DATAFILE/undotbs1.267.1132177009 +DATA/DB1/F7852758DCD6B800E0533A0F1EAC1DC6/DATAFILE/system.271.1132177853 +DATA/DB1/F7852758DCD6B800E0533A0F1EAC1DC6/DATAFILE/sysaux.272.1132177853 +DATA/DB1/F7852758DCD6B800E0533A0F1EAC1DC6/DATAFILE/undotbs1.270.1132177853 +DATA/DB1/F7852758DCD6B800E0533A0F1EAC1DC6/DATAFILE/users.274.1132177871 NAME +DATA/DB1/F785288BBCD1BA78E0533A0F1EACCD6F/DATAFILE/system.276.1132177871 +DATA/DB1/F785288BBCD1BA78E0533A0F1EACCD6F/DATAFILE/sysaux.277.1132177871 +DATA/DB1/F785288BBCD1BA78E0533A0F1EACCD6F/DATAFILE/undotbs1.275.1132177871 +DATA/DB1/F785288BBCD1BA78E0533A0F1EACCD6F/DATAFILE/users.279.1132177889 +DATA/DB1/F78529A14DD8BB18E0533A0F1EACB8ED/DATAFILE/system.281.1132177889 +DATA/DB1/F78529A14DD8BB18E0533A0F1EACB8ED/DATAFILE/sysaux.282.1132177889 +DATA/DB1/F78529A14DD8BB18E0533A0F1EACB8ED/DATAFILE/undotbs1.280.1132177889 +DATA/DB1/F78529A14DD8BB18E0533A0F1EACB8ED/DATAFILE/users.284.1132177907 19 rows selected. SQL> show pdbs CON_ID CON_NAME OPEN MODE RESTRICTED 2 PDB$SEED READ ONLY NO 3 DB1_PDB1 READ WRITE NO 4 DB1_PDB2 READ WRITE NO 5 DB1_PDB3 READ WRITE NO SQL> -

DB 복구 대상 크기를 +LOGS 디스크 그룹 크기로 설정합니다.

alter system set db_recovery_file_dest_size = 80G scope=both;

-

sqlplus를 사용하여 데이터베이스에 로그인하고 아카이브 로그 모드를 활성화합니다.

sqlplus /as sysdba. shutdown immediate; startup mount; alter database archivelog; alter database open;

이것으로 Amazon FSx ONTAP 및 EC2 컴퓨팅 인스턴스에서 Oracle 19c 버전 19.18 재시작 배포가 완료되었습니다. 원하는 경우 NetApp Oracle 제어 파일과 온라인 로그 파일을 +LOGS 디스크 그룹으로 이전할 것을 권장합니다.

자동 배포 옵션

SnapCenter 서비스를 사용한 Oracle 데이터베이스 백업, 복원 및 복제

보다"Oracle용 SnapCenter 서비스" NetApp BlueXP 콘솔을 사용한 Oracle 데이터베이스 백업, 복원 및 복제에 대한 자세한 내용은 다음을 참조하세요.

추가 정보를 찾을 수 있는 곳

이 문서에 설명된 정보에 대해 자세히 알아보려면 다음 문서 및/또는 웹사이트를 검토하세요.

-

새 데이터베이스 설치로 독립형 서버에 Oracle Grid Infrastructure 설치

-

응답 파일을 사용하여 Oracle 데이터베이스 설치 및 구성

-

Amazon FSx ONTAP

-

아마존 EC2