Speicher-Volumes für Geräte neu mounten und neu formatieren („Manuelle Schritte“)

Änderungen vorschlagen

Änderungen vorschlagen

Führen Sie manuell zwei Skripte aus, um noch intaerte Storage-Volumes neu mounten und ausgefallene Storage Volumes neu formatieren zu können. Das erste Skript bindet Volumes wieder ein, die ordnungsgemäß als StorageGRID-Storage-Volumes formatiert sind. Das zweite Skript formatiert alle nicht abgehängt Volumes neu, stellt die Cassandra-Datenbank bei Bedarf wieder her und startet Services.

-

Sie haben bereits die Hardware für alle ausgefallenen Storage Volumes ausgetauscht, die ausgetauscht werden müssen.

Ausführen des

sn-remount-volumesSkript kann Ihnen helfen, zusätzliche ausgefallene Storage-Volumes zu identifizieren. -

Sie haben überprüft, dass keine Ausmusterung von Storage-Nodes ausgeführt wird oder Sie den Vorgang zur Deaktivierung eines Node angehalten haben. (Wählen Sie im Grid Manager die Option WARTUNG Aufgaben Dekommission.)

-

Sie haben überprüft, dass keine Erweiterung ausgeführt wird. (Wählen Sie im Grid Manager die Option WARTUNG Aufgaben Erweiterung.)

|

Wenden Sie sich an den technischen Support, wenn mehr als ein Speicherknoten offline ist oder wenn ein Speicherknoten in diesem Grid in den letzten 15 Tagen neu aufgebaut wurde. Führen Sie das nicht aus sn-recovery-postinstall.sh Skript: Die Neuerstellung von Cassandra auf zwei oder mehr Storage-Nodes innerhalb von 15 Tagen voneinander kann zu Datenverlust führen.

|

Zum Abschluss dieses Vorgangs führen Sie die folgenden grundlegenden Aufgaben aus:

-

Melden Sie sich beim wiederhergestellten Speicherknoten an.

-

Führen Sie die aus

sn-remount-volumesSkript zum Neumounten ordnungsgemäß formatierter Speicher-Volumes. Wenn dieses Skript ausgeführt wird, führt es Folgendes aus:-

Hängt jedes Storage-Volume an und ab, um das XFS-Journal wiederzugeben.

-

Führt eine Konsistenzprüfung der XFS-Datei durch.

-

Wenn das Dateisystem konsistent ist, bestimmt, ob das Storage Volume ein ordnungsgemäß formatiertes StorageGRID Storage Volume ist.

-

Wenn das Storage Volume ordnungsgemäß formatiert ist, wird das Storage-Volume wieder gemountet. Alle bestehenden Daten auf dem Volume bleiben erhalten.

-

-

Prüfen Sie die Skriptausgabe und beheben Sie etwaige Probleme.

-

Führen Sie die aus

sn-recovery-postinstall.shSkript: Wenn dieses Skript ausgeführt wird, führt es Folgendes aus.Starten Sie einen Speicherknoten während der Wiederherstellung nicht neu, bevor Sie ausführen sn-recovery-postinstall.sh(Schritt 4) zum Neuformatieren der ausgefallenen Storage Volumes und zum Wiederherstellen von Objekt-Metadaten. Vor dem Neubooten des Speicherknotensn-recovery-postinstall.shDurch das Abschließen werden Fehler bei Diensten verursacht, die zu starten versuchen, und die Knoten der StorageGRID-Appliance den Wartungsmodus beenden.-

Umformatiert alle Storage-Volumes, die von der

sn-remount-volumesDas Skript konnte nicht gemountet werden oder es wurde festgestellt, dass es nicht ordnungsgemäß formatiert wurde.Wenn ein Speicher-Volume neu formatiert wird, gehen alle Daten auf diesem Volume verloren. Sie müssen ein zusätzliches Verfahren durchführen, um Objektdaten von anderen Standorten im Grid wiederherzustellen, vorausgesetzt, dass ILM-Regeln für die Speicherung von mehr als einer Objektkopie konfiguriert wurden. -

Stellt die Cassandra-Datenbank bei Bedarf auf dem Node wieder her.

-

Startet die Dienste auf dem Speicherknoten.

-

-

Melden Sie sich beim wiederhergestellten Speicherknoten an:

-

Geben Sie den folgenden Befehl ein:

ssh admin@grid_node_IP -

Geben Sie das im aufgeführte Passwort ein

Passwords.txtDatei: -

Geben Sie den folgenden Befehl ein, um zum Root zu wechseln:

su - -

Geben Sie das im aufgeführte Passwort ein

Passwords.txtDatei:

Wenn Sie als root angemeldet sind, ändert sich die Eingabeaufforderung von

$Bis#. -

-

Führen Sie das erste Skript aus, um alle ordnungsgemäß formatierten Speicher-Volumes neu zu mounten.

Wenn alle Speicher-Volumes neu sind und formatiert werden müssen, oder wenn alle Speicher-Volumes ausgefallen sind, können Sie diesen Schritt überspringen und das zweite Skript ausführen, um alle nicht abgehängt Speicher-Volumes neu zu formatieren. -

Führen Sie das Skript aus:

sn-remount-volumesDieses Skript kann Stunden dauern, bis es auf Storage-Volumes ausgeführt wird, die Daten enthalten.

-

Überprüfen Sie die Ausgabe, während das Skript ausgeführt wird, und beantworten Sie alle Eingabeaufforderungen.

Nach Bedarf können Sie die verwenden tail -fBefehl zum Überwachen des Inhalts der Protokolldatei des Skripts (/var/local/log/sn-remount-volumes.log) . Die Protokolldatei enthält ausführlichere Informationen als die Befehlsausgabe der Befehlszeile.root@SG:~ # sn-remount-volumes The configured LDR noid is 12632740 ====== Device /dev/sdb ====== Mount and unmount device /dev/sdb and checking file system consistency: The device is consistent. Check rangedb structure on device /dev/sdb: Mount device /dev/sdb to /tmp/sdb-654321 with rangedb mount options This device has all rangedb directories. Found LDR node id 12632740, volume number 0 in the volID file Attempting to remount /dev/sdb Device /dev/sdb remounted successfully ====== Device /dev/sdc ====== Mount and unmount device /dev/sdc and checking file system consistency: Error: File system consistency check retry failed on device /dev/sdc. You can see the diagnosis information in the /var/local/log/sn-remount-volumes.log. This volume could be new or damaged. If you run sn-recovery-postinstall.sh, this volume and any data on this volume will be deleted. If you only had two copies of object data, you will temporarily have only a single copy. StorageGRID Webscale will attempt to restore data redundancy by making additional replicated copies or EC fragments, according to the rules in the active ILM policy. Do not continue to the next step if you believe that the data remaining on this volume cannot be rebuilt from elsewhere in the grid (for example, if your ILM policy uses a rule that makes only one copy or if volumes have failed on multiple nodes). Instead, contact support to determine how to recover your data. ====== Device /dev/sdd ====== Mount and unmount device /dev/sdd and checking file system consistency: Failed to mount device /dev/sdd This device could be an uninitialized disk or has corrupted superblock. File system check might take a long time. Do you want to continue? (y or n) [y/N]? y Error: File system consistency check retry failed on device /dev/sdd. You can see the diagnosis information in the /var/local/log/sn-remount-volumes.log. This volume could be new or damaged. If you run sn-recovery-postinstall.sh, this volume and any data on this volume will be deleted. If you only had two copies of object data, you will temporarily have only a single copy. StorageGRID Webscale will attempt to restore data redundancy by making additional replicated copies or EC fragments, according to the rules in the active ILM policy. Do not continue to the next step if you believe that the data remaining on this volume cannot be rebuilt from elsewhere in the grid (for example, if your ILM policy uses a rule that makes only one copy or if volumes have failed on multiple nodes). Instead, contact support to determine how to recover your data. ====== Device /dev/sde ====== Mount and unmount device /dev/sde and checking file system consistency: The device is consistent. Check rangedb structure on device /dev/sde: Mount device /dev/sde to /tmp/sde-654321 with rangedb mount options This device has all rangedb directories. Found LDR node id 12000078, volume number 9 in the volID file Error: This volume does not belong to this node. Fix the attached volume and re-run this script.

In der Beispielausgabe wurde ein Storage-Volume erfolgreich neu eingebunden und drei Storage-Volumes wiesen Fehler auf.

-

/dev/sdbDie Konsistenzprüfung des XFS-Dateisystems wurde bestanden und hatte eine gültige Volume-Struktur, so dass es erfolgreich neu eingebunden wurde. Daten auf Geräten, die vom Skript neu eingebunden werden, bleiben erhalten. -

/dev/sdcDie Konsistenzprüfung des XFS-Dateisystems ist fehlgeschlagen, da das Speichervolume neu oder beschädigt war. -

/dev/sddKonnte nicht gemountet werden, da die Festplatte nicht initialisiert wurde oder der Superblock der Festplatte beschädigt war. Wenn das Skript kein Speicher-Volume mounten kann, wird gefragt, ob Sie die Konsistenzprüfung des Dateisystems ausführen möchten.-

Wenn das Speichervolumen an eine neue Festplatte angeschlossen ist, beantworten Sie N mit der Eingabeaufforderung. Sie müssen das Dateisystem auf einer neuen Festplatte nicht überprüfen.

-

Wenn das Speichervolumen an eine vorhandene Festplatte angeschlossen ist, beantworten Sie Y mit der Eingabeaufforderung. Sie können die Ergebnisse der Dateisystemüberprüfung verwenden, um die Quelle der Beschädigung zu bestimmen. Die Ergebnisse werden im gespeichert

/var/local/log/sn-remount-volumes.logProtokolldatei.

-

-

/dev/sdeDie Konsistenzprüfung des XFS-Dateisystems wurde bestanden und eine gültige Volume-Struktur hatte; die LDR-Knoten-ID befindet sich jedoch imvolIDDie Datei stimmt nicht mit der ID für diesen Speicherknoten überein (derconfigured LDR noidOben angezeigt). Diese Meldung gibt an, dass dieses Volume zu einem anderen Speicherknoten gehört.

-

-

-

Prüfen Sie die Skriptausgabe und beheben Sie etwaige Probleme.

Wenn ein Speichervolume die Konsistenzprüfung des XFS-Dateisystems fehlgeschlagen ist oder nicht gemountet werden konnte, überprüfen Sie sorgfältig die Fehlermeldungen in der Ausgabe. Sie müssen die Auswirkungen der Ausführung des verstehen sn-recovery-postinstall.shSkript auf diesen Volumen.-

Überprüfen Sie, ob die Ergebnisse einen Eintrag für alle Volumes enthalten, die Sie erwartet haben. Wenn keine Volumes aufgeführt sind, führen Sie das Skript erneut aus.

-

Überprüfen Sie die Meldungen für alle angeschlossenen Geräte. Stellen Sie sicher, dass keine Fehler vorliegen, die darauf hinweisen, dass ein Speichervolume nicht zu diesem Speicherknoten gehört.

Im Beispiel enthält die Ausgabe für /dev/sde die folgende Fehlermeldung:

Error: This volume does not belong to this node. Fix the attached volume and re-run this script.

Wenn ein Storage-Volume gemeldet wird, das zu einem anderen Storage Node gehört, wenden Sie sich an den technischen Support. Wenn Sie den ausführen sn-recovery-postinstall.shSkript: Das Speichervolumen wird neu formatiert, was zu Datenverlust führen kann. -

Wenn keine Speichergeräte montiert werden konnten, notieren Sie sich den Gerätenamen und reparieren oder ersetzen Sie das Gerät.

Sie müssen Speichergeräte reparieren oder ersetzen, die nicht montiert werden können. Sie verwenden den Gerätenamen, um die Volume-ID zu suchen. Dies ist erforderlich, wenn Sie den ausführen

repair-dataSkript zum Wiederherstellen von Objektdaten auf dem Volume (beim nächsten Verfahren). -

Führen Sie nach der Reparatur oder dem Austausch aller nicht montierbaren Geräte den aus

sn-remount-volumesSkript erneut, um zu bestätigen, dass alle Speicher-Volumes, die neu gemountet werden können, neu eingebunden wurden.Wenn ein Speicher-Volume nicht angehängt oder nicht ordnungsgemäß formatiert werden kann, und Sie mit dem nächsten Schritt fortfahren, werden das Volume und alle Daten auf dem Volume gelöscht. Falls Sie zwei Kopien von Objektdaten hatten, ist nur eine einzige Kopie verfügbar, bis Sie das nächste Verfahren (Wiederherstellen von Objektdaten) abgeschlossen haben.

Führen Sie das nicht aus sn-recovery-postinstall.shSkript, wenn Sie der Meinung sind, dass die in einem ausgefallenen Storage Volume verbliebenen Daten nicht von einer anderen Stelle im Grid wiederhergestellt werden können (falls Ihre ILM-Richtlinie eine Regel verwendet, die nur eine Kopie macht, oder falls Volumes auf mehreren Nodes ausgefallen sind). Wenden Sie sich stattdessen an den technischen Support, um zu ermitteln, wie Sie Ihre Daten wiederherstellen können. -

-

Führen Sie die aus

sn-recovery-postinstall.shSkript:sn-recovery-postinstall.shDieses Skript formatiert alle Storage-Volumes, die nicht gemountet werden konnten oder die sich als falsch formatiert herausfanden. Darüber hinaus wird die Cassandra-Datenbank bei Bedarf auf dem Node wiederhergestellt und die Services auf dem Storage-Node gestartet.

Beachten Sie Folgendes:

-

Das Skript kann Stunden in Anspruch nehmen.

-

Im Allgemeinen sollten Sie die SSH-Sitzung allein lassen, während das Skript ausgeführt wird.

-

Drücken Sie nicht Strg+C, wenn die SSH-Sitzung aktiv ist.

-

Das Skript wird im Hintergrund ausgeführt, wenn eine Netzwerkunterbrechung auftritt und die SSH-Sitzung beendet wird. Sie können jedoch den Fortschritt auf der Seite Wiederherstellung anzeigen.

-

Wenn der Storage-Node den RSM-Service verwendet, wird das Skript möglicherweise 5 Minuten lang blockiert, während die Node-Services neu gestartet werden. Diese 5-minütige Verzögerung wird erwartet, wenn der RSM-Dienst zum ersten Mal startet.

Der RSM-Dienst ist auf Speicherknoten vorhanden, die den ADC-Service enthalten.

Einige StorageGRID-Wiederherstellungsverfahren verwenden Reaper für die Bearbeitung von Cassandra-Reparaturen. Reparaturen werden automatisch ausgeführt, sobald die entsprechenden oder erforderlichen Services gestartet wurden. Sie können die Skriptausgabe bemerken, die “reaper” oder “Cassandra Reparatur erwähnt.” Wenn eine Fehlermeldung angezeigt wird, dass die Reparatur fehlgeschlagen ist, führen Sie den in der Fehlermeldung angegebenen Befehl aus. -

-

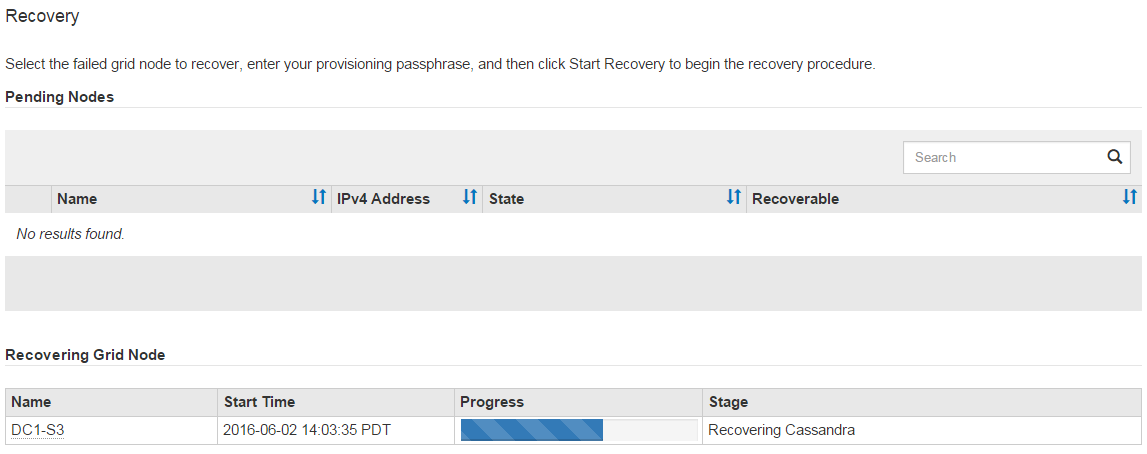

Als der

sn-recovery-postinstall.shSkript wird ausgeführt, überwachen Sie die Wiederherstellungsseite im Grid Manager.Die Fortschrittsanzeige und die Spalte Phase auf der Seite Wiederherstellung geben einen allgemeinen Status des an

sn-recovery-postinstall.shSkript:

Nach dem sn-recovery-postinstall.sh Skript hat Dienste auf dem Knoten gestartet. Sie können Objektdaten auf allen Speicher-Volumes wiederherstellen, die durch das Skript formatiert wurden, wie im nächsten Verfahren beschrieben.

Prüfen Sie die Warnungen für die Wiederherstellung von Speicherknoten-Laufwerken