MetroCluster IP設定を展開します

変更を提案

変更を提案

ONTAP のバージョンに応じて、4つの新しいノードを新しいDRグループとして追加することでMetroCluster IP構成を拡張できます。

ONTAP 9.13.1以降では、8ノードMetroCluster構成を一時的に拡張してコントローラとストレージを更新できます。を参照してください "4ノードまたは8ノードのMetroCluster IP構成の更新(ONTAP 9.8以降)" を参照してください。

ONTAP 9.9.9..1 以降では、 4 つの新しいノードを 2 つ目の DR グループとして MetroCluster IP 構成に追加できます。これにより、 8 ノード MetroCluster 構成が作成されます。

次のガイダンスは、新しいプラットフォーム モデル ( ONTAP 9.15.1 以降でリリースされたプラットフォーム) を含む既存のMetroCluster構成に古いプラットフォーム モデル ( ONTAP 9.15.1 より前にリリースされたプラットフォーム) を追加する必要がある、まれなシナリオを対象としています。

既存のMetroCluster構成に、共有クラスタ/HA ポート を使用するプラットフォーム ( ONTAP 9.15.1 以降でリリースされたプラットフォーム) が含まれている場合、構成内のすべてのノードをONTAP 9.15.1P11 またはONTAP 9.16.1P4 以降にアップグレードせずに、共有MetroCluster/HA ポート を使用するプラットフォーム ( ONTAP 9.15.1 より前にリリースされたプラットフォーム) を追加することはできません。

|

共有/ MetroCluster HA ポート を使用する古いプラットフォーム モデルを、共有クラスタ/HA ポート を使用する新しいプラットフォーム モデルを含むMetroClusterに追加することはまれなシナリオであり、ほとんどの組み合わせは影響を受けません。 |

次の表を使用して、組み合わせが影響を受けるかどうかを確認してください。既存のプラットフォームが最初の列にリストされ、構成に追加するプラットフォームが 2 番目の列にリストされている場合、新しい DR グループを追加するには、構成内のすべてのノードでONTAP 9.15.1P11 またはONTAP 9.16.1P4 以降が実行されている必要があります。

| 既存の MetroCluster に以下が含まれている場合… | 追加するプラットフォームは… | 作業 | ||

|---|---|---|---|---|

共有クラスター/HA ポート を使用する AFF システム:

|

共有クラスター/HA ポート を使用する FAS システム:

|

共有 MetroCluster/HA ポート を使用する AFF システム:

|

共有 MetroCluster/HA ポート を使用する FAS システム:

|

既存の MetroCluster 構成に新しいプラットフォームを追加する前に、既存および新しい構成内のすべてのノードを ONTAP 9.15.1P11 または ONTAP 9.16.1P4 以降にアップグレードします。 |

-

古いノードと新しいノードで同じバージョンの ONTAP を実行する必要があります。

-

この手順では、既存のMetroCluster IP構成に4ノードDRグループを1つ追加する手順について説明します。8ノード構成を更新する場合は、手順全体をDRグループごとに1つずつ追加して繰り返す必要があります。

-

新旧のプラットフォームモデルでプラットフォームの混在がサポートされていることを確認します。

-

古いプラットフォームモデルと新しいプラットフォームモデルの両方がIPスイッチでサポートされていることを確認します。

-

実行中の場合 "4ノードまたは8ノードのMetroCluster IP構成の更新"新しいノードには、古いノードのデータを収容するための十分なストレージに加え、ルートアグリゲート用の十分なディスクとスペアディスクが必要です。

-

古いノードにデフォルトのブロードキャストドメインが作成されていることを確認します。

デフォルトのブロードキャストドメインがない既存のクラスタに新しいノードを追加すると、想定される名前ではなくUniversal Unique Identifier(UUID)を使用して新しいノード用のノード管理LIFが作成されます。詳細については、技術情報アーティクルを参照してください "UUID名で生成された新しく追加されたノードのノード管理LIF"。

コンソールログを有効にする

NetAppでは、使用しているデバイスでコンソールロギングをイネーブルにし、この手順を実行する際に次のアクションを実行することを強く推奨します。

-

メンテナンス中はAutoSupportを有効のままにします。

-

メンテナンスの前後にメンテナンスAutoSupportメッセージをトリガーして、メンテナンスアクティビティ中にケースの作成を無効にします。

ナレッジベースの記事を参照してください "スケジュールされたメンテナンス時間中にケースの自動作成を停止する方法"。

-

任意のCLIセッションのセッションロギングをイネーブルにします。セッションログを有効にする方法については、ナレッジベースの記事の「セッション出力のログ」セクションを参照してください "ONTAPシステムへの接続を最適化するためのPuTTYの設定方法"。

この手順での命名例

この手順では、全体的な名前の例を使用して、 DR グループ、ノード、および関連するスイッチを特定します。

DR グループ |

site_A で cluster_A |

site_B ( site_B |

dr_group_1 - 古い |

|

|

dr_group_2 - 新規 |

|

|

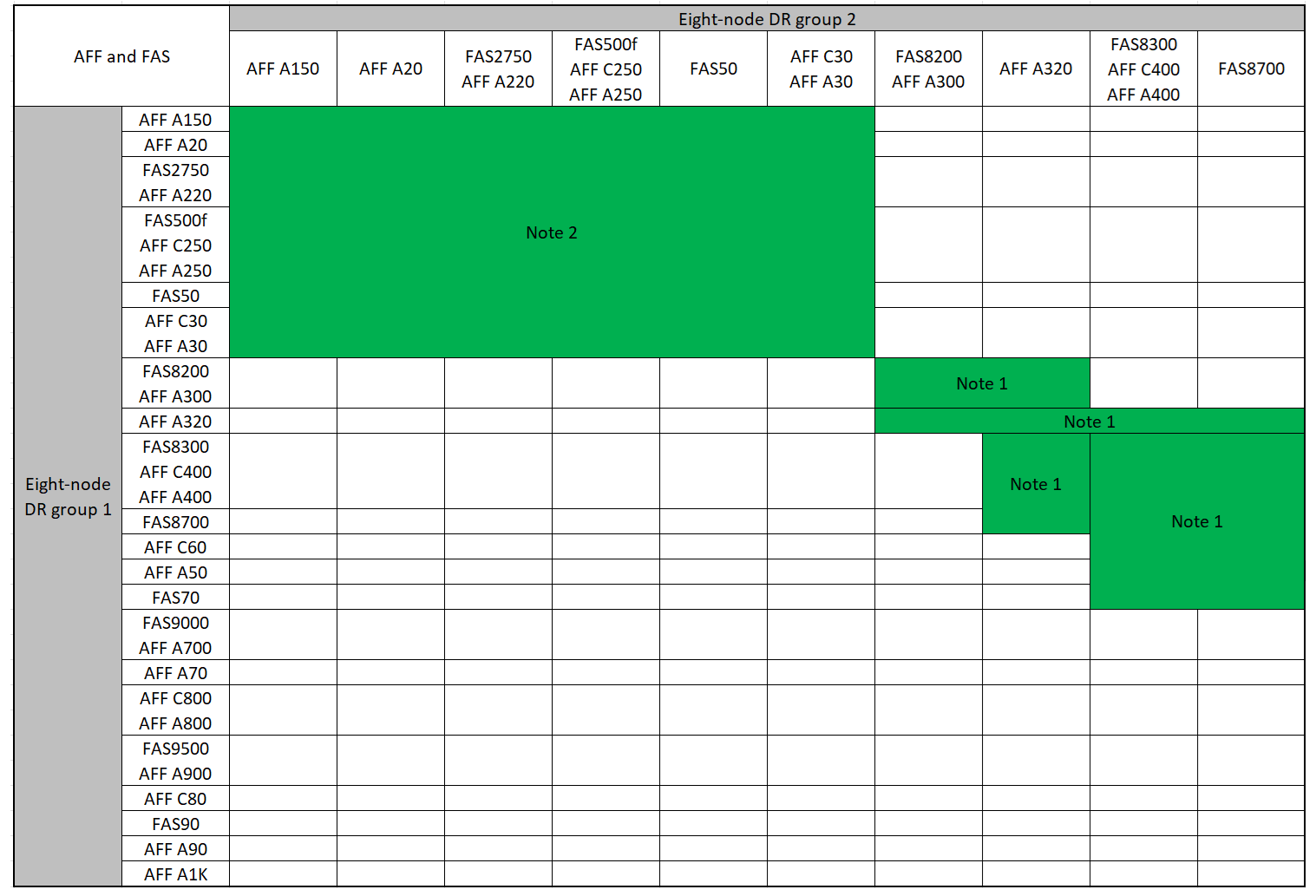

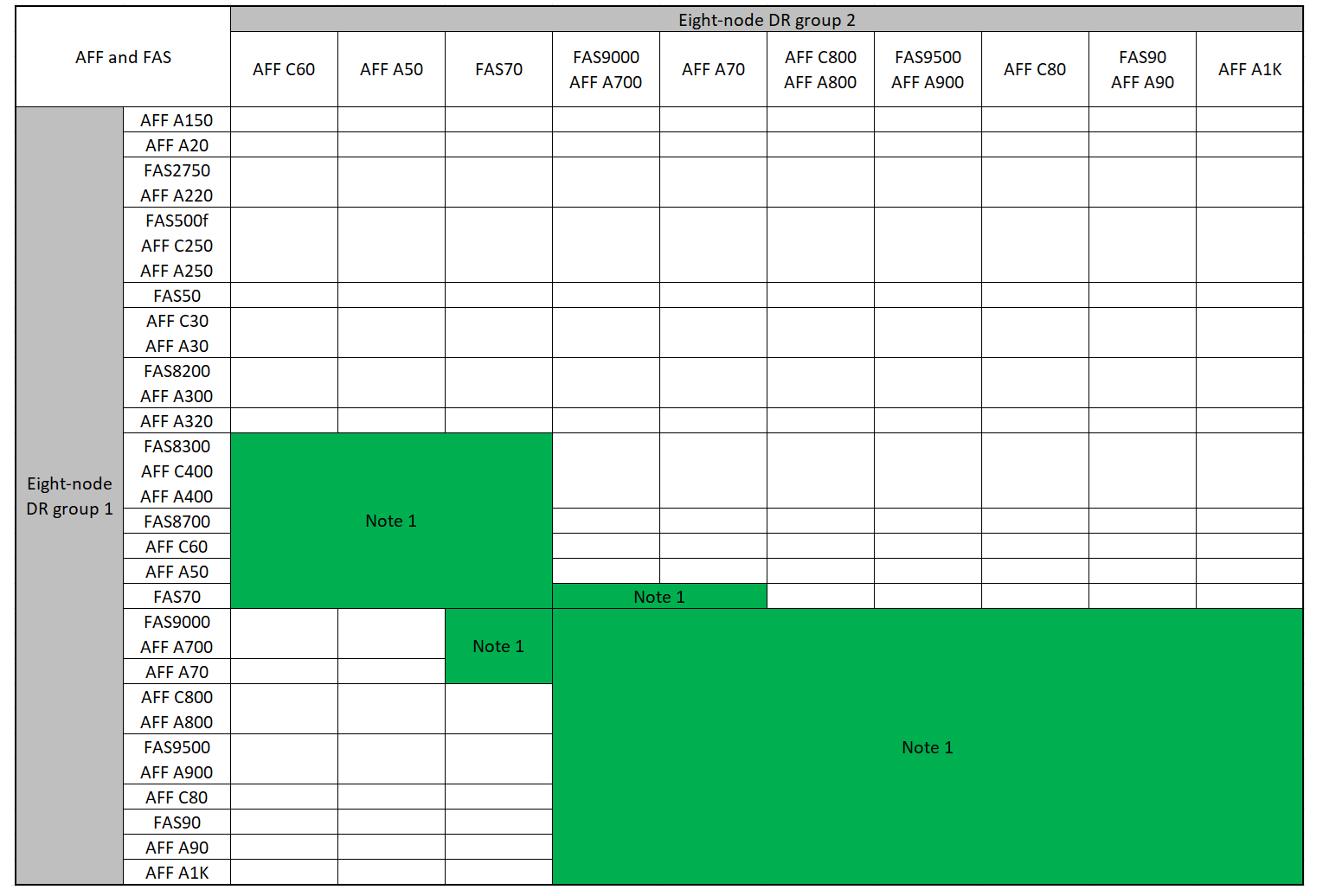

2つ目のDRグループを追加する際にサポートされるプラットフォームの組み合わせ

次の表に、8ノードMetroCluster IP構成でサポートされるプラットフォームの組み合わせを示します。

|

|

サポートされるAFFとFAS MetroCluster IPの拡張の組み合わせ

次の表に、MetroCluster IP構成でAFFシステムまたはFASシステムを拡張する場合にサポートされるプラットフォームの組み合わせを示します。テーブルは次の2つのグループに分割されます。

-

*グループ1 *は、、AFF A20、FAS2750、AFF A220、AFF A150、FAS500f、AFF C250、FAS8200、FAS50、AFF C400 C30、AFF A30、AFF A250、AFF A300、AFF A400、FAS8700、AFF、AFF A320、FAS8300システムの組み合わせを示しています。

-

*グループ2 *は、AFF C60、AFF A50、FAS70、FAS9000、AFF A700、AFF A70、AFF C800、AFF、FAS9500、AFF A900、AFF A800 C80、FAS90、AFF A90、およびAFF A1Kシステムの組み合わせを示しています。

次の注意事項は両方のグループに適用されます。

-

注1:これらの組み合わせには、ONTAP 9.9.1以降(またはプラットフォームでサポートされるONTAPの最小バージョン)が必要です。

-

注2:これらの組み合わせには、ONTAP 9.13.1以降(またはプラットフォームでサポートされるONTAPの最小バージョン)が必要です。

AFF A150、AFF A20、FAS2750 AFF A400、AFF A220、FAS500f、AFF A320、FAS8200、FAS50、AFF C30、AFF A30、AFF A250、AFF C400、AFF C250、FAS8300、AFF A300、FAS8700システムの拡張の組み合わせを確認します。

C60、AFF A50、FAS70、FAS9000、AFF A700、AFF A70、AFF C800、AFF、AFF A90、AFF、AFF A1K、AFF A800 C80、FAS90、FAS9500、AFF A900システムの拡張の組み合わせを確認します。

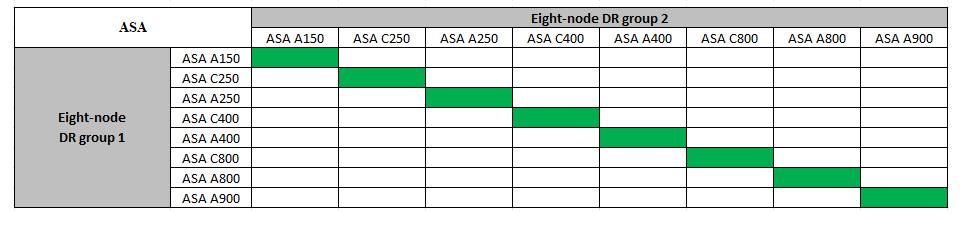

サポートされるASA MetroCluster IP拡張の組み合わせ

次の表に、MetroCluster IP構成でASAシステムを拡張する場合にサポートされるプラットフォームの組み合わせを示します。

カスタム AutoSupport メッセージをメンテナンス前に送信する

メンテナンスを実行する前に、 AutoSupport an 問題 message to notify NetApp technical support that maintenance is maintenancing (メンテナンスが進行中であることをネットアップテクニカルサポートに通知する)を実行システム停止が発生したとみなしてテクニカルサポートがケースをオープンしないように、メンテナンスが進行中であることを通知する必要があります。

このタスクは MetroCluster サイトごとに実行する必要があります。

-

サポートケースが自動で生成されないようにするには、アップグレードが進行中であることを示す AutoSupport メッセージを送信します。

-

次のコマンドを問題に設定します。

system node autosupport invoke -node * -type all -message "MAINT=10h Upgrading <old-model> to <new-model>この例では、 10 時間のメンテナンス時間を指定しています。プランによっては、さらに時間をかけたい場合もあります。

この時間が経過する前にメンテナンスが完了した場合は、メンテナンス期間が終了したことを通知する AutoSupport メッセージを起動できます。

「 system node AutoSupport invoke -node * -type all -message MAINT= end 」というメッセージが表示されます

-

パートナークラスタに対してこのコマンドを繰り返します。

-

新しいDRグループを追加する際のVLANに関する考慮事項

-

MetroCluster IP構成を拡張する場合は、次のVLANに関する考慮事項が適用されます。

特定のプラットフォームでは、MetroCluster IPインターフェイスにVLANが使用されます。デフォルトでは、 2 つのポートでそれぞれ 10 と 20 の異なる VLAN が使用されます。

サポートされている場合は、コマンドのパラメータを使用して、100より大きい別の(デフォルト以外の)VLAN(101 ~ 4095)を指定することもできます

-vlan-idmetrocluster configuration-settings interface create。次のプラットフォームでは、パラメーターは*サポートされていません*

-vlan-id。-

FAS8200 と AFF A300

-

AFF A320

-

FAS9000およびAFF A700

-

AFF C800、ASA C800、AFF A800、およびASA A800

他のすべてのプラットフォームでは、パラメータがサポートされ

-vlan-idます。デフォルトおよび有効なVLAN割り当ては、プラットフォームがパラメータをサポートしているかどうかによって異なり

-vlan-idます。

vlan-vlan-id </code>をサポートするプラットフォーム<code>デフォルトVLAN:

-

パラメータを指定しない場合、

-vlan-idインターフェイスは「A」ポートにVLAN 10、「B」ポートにVLAN 20で作成されます。 -

指定するVLANは、RCFで選択したVLANと一致する必要があります。

有効なVLAN範囲:

-

デフォルトVLAN 10および20

-

VLAN 101以上(101~4095)

vlan-vlan-id </code>をサポートしないプラットフォーム<code>デフォルトVLAN:

-

該当なし。このインターフェイスでは、MetroClusterインターフェイスでVLANを指定する必要はありません。スイッチポートによって、使用されるVLANが定義されます。

有効なVLAN範囲:

-

RCFの生成時にすべてのVLANが明示的に除外されていない。VLANが無効な場合は、RCFから警告が表示されます。

-

-

4ノードから8ノードのMetroCluster構成に拡張する場合は、両方のDRグループで同じVLANが使用されます。

-

同じVLANを使用して両方のDRグループを設定できない場合は、パラメータをサポートしていないDRグループをアップグレードして、他のDRグループでサポートされているVLANを使用する必要があり

vlan-idます。

MetroCluster 構成の健全性を確認

拡張を実行する前に、MetroCluster構成の健全性と接続を確認する必要があります。

-

ONTAP で MetroCluster 構成の動作を確認します。

-

システムがマルチパスかどうかを確認します。

node run -node <node-name> sysconfig -a -

ヘルスアラートがないかどうかを両方のクラスタで確認します。

「 system health alert show 」というメッセージが表示されます

-

MetroCluster 構成と運用モードが正常な状態であることを確認します。

「 MetroCluster show 」

-

MetroCluster チェックを実行します。

「 MetroCluster check run 」のようになります

-

MetroCluster チェックの結果を表示します。

MetroCluster チェックショー

-

Config Advisor を実行します。

-

Config Advisor の実行後、ツールの出力を確認し、推奨される方法で検出された問題に対処します。

-

-

クラスタが正常であることを確認します。

「 cluster show 」を参照してください

cluster_A::> cluster show Node Health Eligibility -------------- ------ ----------- node_A_1 true true node_A_2 true true cluster_A::>

-

すべてのクラスタポートが動作していることを確認します。

「 network port show -ipspace cluster 」のように表示されます

cluster_A::> network port show -ipspace Cluster Node: node_A_1-old Speed(Mbps) Health Port IPspace Broadcast Domain Link MTU Admin/Oper Status --------- ------------ ---------------- ---- ---- ----------- -------- e0a Cluster Cluster up 9000 auto/10000 healthy e0b Cluster Cluster up 9000 auto/10000 healthy Node: node_A_2-old Speed(Mbps) Health Port IPspace Broadcast Domain Link MTU Admin/Oper Status --------- ------------ ---------------- ---- ---- ----------- -------- e0a Cluster Cluster up 9000 auto/10000 healthy e0b Cluster Cluster up 9000 auto/10000 healthy 4 entries were displayed. cluster_A::> -

すべてのクラスタ LIF が動作していることを確認します。

「 network interface show -vserver Cluster 」のように表示されます

各クラスタ LIF で、 Is Home には true 、 Status Admin/Oper には up/up と表示されるはずです

cluster_A::> network interface show -vserver cluster Logical Status Network Current Current Is Vserver Interface Admin/Oper Address/Mask Node Port Home ----------- ---------- ---------- ------------------ ------------- ------- ----- Cluster node_A_1-old_clus1 up/up 169.254.209.69/16 node_A_1 e0a true node_A_1-old_clus2 up/up 169.254.49.125/16 node_A_1 e0b true node_A_2-old_clus1 up/up 169.254.47.194/16 node_A_2 e0a true node_A_2-old_clus2 up/up 169.254.19.183/16 node_A_2 e0b true 4 entries were displayed. cluster_A::> -

すべてのクラスタ LIF で自動リバートが有効になっていることを確認します。

network interface show -vserver Cluster -fields auto-revert を実行します

cluster_A::> network interface show -vserver Cluster -fields auto-revert Logical Vserver Interface Auto-revert --------- ------------- ------------ Cluster node_A_1-old_clus1 true node_A_1-old_clus2 true node_A_2-old_clus1 true node_A_2-old_clus2 true 4 entries were displayed. cluster_A::>

監視アプリケーションから設定を削除します

ONTAP Tiebreaker ソフトウェア、 MetroCluster メディエーター、またはスイッチオーバーを開始できるその他の他社製アプリケーション( ClusterLion など)で既存の構成を監視している場合は、アップグレードの前に、監視ソフトウェアから MetroCluster 構成を削除する必要があります。

-

Tiebreaker 、メディエーター、またはスイッチオーバーを開始できるその他のソフトウェアから既存の MetroCluster 構成を削除します。

使用するポート

使用する手順

Tiebreaker

メディエーター

ONTAP プロンプトで次のコマンドを問題に設定します。

MetroCluster 構成設定のメディエーターが削除されました

サードパーティ製アプリケーション

製品マニュアルを参照してください。

-

スイッチオーバーを開始できるサードパーティ製アプリケーションから既存の MetroCluster 構成を削除します。

アプリケーションのマニュアルを参照してください。

新しいコントローラモジュールを準備する

4 つの新しい MetroCluster ノードを準備し、正しいバージョンの ONTAP をインストールする必要があります。

このタスクは新しい各ノードで実行する必要があります。

-

Node_a_3 - 新規

-

Node_a_4 - 新規

-

node_B_2 - 新規

-

node_B_2 - 新規

この手順では、ノードの設定をクリアし、新しいドライブのメールボックスのリージョンをクリアします。

-

新しいコントローラをラックに設置します。

-

に示すように、新しいMetroCluster IPノードをIPスイッチにケーブル接続し "IPスイッチのケーブル接続"ます。

-

次の手順に従ってMetroCluster IPノードを設定します。

-

メンテナンスモードから、haltコマンドを発行してメンテナンスモードを終了します:

「 halt 」

-

partner-sysid が正しいかどうかを確認します。

printenv partner-sysid

-

partner-sysid が正しくない場合は、次のように設定します。

setenv partner-sysid <partner-sysID> -

システムを起動し、クラスタ設定画面に進みます:

「 boot_ontap 」

このとき、クラスタウィザードやノードウィザードを実行しないでください。

RCF ファイルをアップグレードします

新しいスイッチファームウェアをインストールする場合は、 RCF ファイルをアップグレードする前にスイッチファームウェアをインストールする必要があります。

この手順では、 RCF ファイルをアップグレードするスイッチ上のトラフィックが中断されます。新しい RCF ファイルが適用されると、トラフィックは再開されます。

-

構成の健全性を確認

-

MetroCluster コンポーネントが正常であることを確認します。

「 MetroCluster check run 」のようになります

cluster_A::*> metrocluster check run

この処理はバックグラウンドで実行されます。

-

MetroCluster check run オペレーションが完了したら ' MetroCluster check show を実行して結果を表示します

約 5 分後に、次の結果が表示されます。

----------- ::*> metrocluster check show Component Result ------------------- --------- nodes ok lifs ok config-replication ok aggregates ok clusters ok connections ok volumes ok 7 entries were displayed.

-

実行中の MetroCluster チェック処理のステータスを確認します。

MetroCluster オペレーション履歴 show -job-id 38`

-

ヘルスアラートがないことを確認します。

「 system health alert show 」というメッセージが表示されます

-

-

新しい RCF ファイルを適用するための IP スイッチを準備します。

スイッチベンダーの手順に従います。

-

スイッチベンダーに応じて、IP RCFファイルをダウンロードしてインストールします。

スイッチを次の順序で更新します。Switch_A_1、Switch_B_1、Switch_A_1、Switch_B_2 -

"NVIDIA IP RCFファイルのダウンロードとインストール"

L2共有またはL3ネットワーク構成の場合は、中間スイッチまたはお客様のスイッチのISLポートの調整が必要になることがあります。スイッチポートモードが「access」から「trunk」モードに変わる可能性があります。2つ目のスイッチペア(A_2、B_2)のアップグレードに進むのは、スイッチA_1とB_1間のネットワーク接続が完全に動作していて、ネットワークが正常な場合だけにしてください。

新しいノードをクラスタに追加

4 つの新しい MetroCluster IP ノードを既存の MetroCluster 構成に追加する必要があります。

このタスクは両方のクラスタで実行する必要があります。

-

新しい MetroCluster IP ノードを既存の MetroCluster 構成に追加

-

最初の新しい MetroCluster IP ノード( node_A_1 の新しいノード)を既存の MetroCluster IP 構成に追加します。

Welcome to the cluster setup wizard. You can enter the following commands at any time: "help" or "?" - if you want to have a question clarified, "back" - if you want to change previously answered questions, and "exit" or "quit" - if you want to quit the cluster setup wizard. Any changes you made before quitting will be saved. You can return to cluster setup at any time by typing "cluster setup". To accept a default or omit a question, do not enter a value. This system will send event messages and periodic reports to NetApp Technical Support. To disable this feature, enter autosupport modify -support disable within 24 hours. Enabling AutoSupport can significantly speed problem determination and resolution, should a problem occur on your system. For further information on AutoSupport, see: http://support.netapp.com/autosupport/ Type yes to confirm and continue {yes}: yes Enter the node management interface port [e0M]: 172.17.8.93 172.17.8.93 is not a valid port. The physical port that is connected to the node management network. Examples of node management ports are "e4a" or "e0M". You can type "back", "exit", or "help" at any question. Enter the node management interface port [e0M]: Enter the node management interface IP address: 172.17.8.93 Enter the node management interface netmask: 255.255.254.0 Enter the node management interface default gateway: 172.17.8.1 A node management interface on port e0M with IP address 172.17.8.93 has been created. Use your web browser to complete cluster setup by accessing https://172.17.8.93 Otherwise, press Enter to complete cluster setup using the command line interface: Do you want to create a new cluster or join an existing cluster? {create, join}: join Existing cluster interface configuration found: Port MTU IP Netmask e0c 9000 169.254.148.217 255.255.0.0 e0d 9000 169.254.144.238 255.255.0.0 Do you want to use this configuration? {yes, no} [yes]: yes . . . -

2 つ目の新しい MetroCluster IP ノード( node_A_1 の新しいノード)を既存の MetroCluster IP 構成に追加します。

-

-

同じ手順を繰り返して、 node_B_1 の新規クラスタ B に node_B_2 を追加します

クラスタピアリング用のクラスタ間LIFを設定

MetroCluster パートナークラスタ間の通信に使用するポートにクラスタ間 LIF を作成する必要があります。専用のポートを使用することも、データトラフィック用を兼ねたポートを使用することもできます。

専用ポートにクラスタ間 LIF を設定できます。通常は、レプリケーショントラフィックに使用できる帯域幅が増加します。

-

クラスタ内のポートの一覧を表示します。

「 network port show 」のように表示されます

コマンド構文の詳細については、"ONTAPコマンド リファレンス"を参照してください。

次の例は、「 cluster01 」内のネットワークポートを示しています。

cluster01::> network port show Speed (Mbps) Node Port IPspace Broadcast Domain Link MTU Admin/Oper ------ --------- ------------ ---------------- ----- ------- ------------ cluster01-01 e0a Cluster Cluster up 1500 auto/1000 e0b Cluster Cluster up 1500 auto/1000 e0c Default Default up 1500 auto/1000 e0d Default Default up 1500 auto/1000 e0e Default Default up 1500 auto/1000 e0f Default Default up 1500 auto/1000 cluster01-02 e0a Cluster Cluster up 1500 auto/1000 e0b Cluster Cluster up 1500 auto/1000 e0c Default Default up 1500 auto/1000 e0d Default Default up 1500 auto/1000 e0e Default Default up 1500 auto/1000 e0f Default Default up 1500 auto/1000 -

クラスタ間通信専用に使用可能なポートを特定します。

network interface show -fields home-port 、 curr -port

コマンド構文の詳細については、"ONTAPコマンド リファレンス"を参照してください。

次の例は、ポート e0e とポート e0f に LIF が割り当てられていないことを示しています。

cluster01::> network interface show -fields home-port,curr-port vserver lif home-port curr-port ------- -------------------- --------- --------- Cluster cluster01-01_clus1 e0a e0a Cluster cluster01-01_clus2 e0b e0b Cluster cluster01-02_clus1 e0a e0a Cluster cluster01-02_clus2 e0b e0b cluster01 cluster_mgmt e0c e0c cluster01 cluster01-01_mgmt1 e0c e0c cluster01 cluster01-02_mgmt1 e0c e0c -

専用ポートのフェイルオーバーグループを作成します。

network interface failover-groups create -vserver <system_svm> -failover-group <failover_group> -targets <physical_or_logical_ports>次の例では、SVM「cluster01」上のフェイルオーバーグループ「intercluster01」にポート「e0e」と「e0f」を割り当てます:

cluster01::> network interface failover-groups create -vserver cluster01 -failover-group intercluster01 -targets cluster01-01:e0e,cluster01-01:e0f,cluster01-02:e0e,cluster01-02:e0f

-

フェイルオーバーグループが作成されたことを確認します。

「 network interface failover-groups show 」と表示されます

コマンド構文の詳細については、"ONTAPコマンド リファレンス"を参照してください。

cluster01::> network interface failover-groups show Failover Vserver Group Targets ---------------- ---------------- -------------------------------------------- Cluster Cluster cluster01-01:e0a, cluster01-01:e0b, cluster01-02:e0a, cluster01-02:e0b cluster01 Default cluster01-01:e0c, cluster01-01:e0d, cluster01-02:e0c, cluster01-02:e0d, cluster01-01:e0e, cluster01-01:e0f cluster01-02:e0e, cluster01-02:e0f intercluster01 cluster01-01:e0e, cluster01-01:e0f cluster01-02:e0e, cluster01-02:e0f -

システム SVM にクラスタ間 LIF を作成して、フェイルオーバーグループに割り当てます。

network interface create -vserver <system_svm> -lif <lif_name> -service-policy default-intercluster -home-node <node_name> -home-port <port_name> -address <port_ip_address> -netmask <netmask_address> -failover-group <failover_group>次の例は、フェイルオーバーグループ「 intercluster01 」にクラスタ間 LIF 「 cluster01_icl01 」と「 cluster01_icl02 」を作成します。

cluster01::> network interface create -vserver cluster01 -lif cluster01_icl01 -service- policy default-intercluster -home-node cluster01-01 -home-port e0e -address 192.168.1.201 -netmask 255.255.255.0 -failover-group intercluster01 cluster01::> network interface create -vserver cluster01 -lif cluster01_icl02 -service- policy default-intercluster -home-node cluster01-02 -home-port e0e -address 192.168.1.202 -netmask 255.255.255.0 -failover-group intercluster01

-

クラスタ間 LIF が作成されたことを確認します。

「 network interface show -service -policy default -intercluster 」のように表示されます

cluster01::> network interface show -service-policy default-intercluster Logical Status Network Current Current Is Vserver Interface Admin/Oper Address/Mask Node Port Home ----------- ---------- ---------- ------------------ ------------- ------- ---- cluster01 cluster01_icl01 up/up 192.168.1.201/24 cluster01-01 e0e true cluster01_icl02 up/up 192.168.1.202/24 cluster01-02 e0e true -

クラスタ間 LIF が冗長構成になっていることを確認します。

「 network interface show -service -policy default -intercluster-failover 」のように入力します

次の例は、ポート「e0e」上のクラスタ間LIF「cluster01_icl01」と「cluster01_icl02」がポート「e0f」にフェイルオーバーすることを示しています。

cluster01::> network interface show -service-policy default-intercluster -failover Logical Home Failover Failover Vserver Interface Node:Port Policy Group -------- --------------- --------------------- --------------- -------- cluster01 cluster01_icl01 cluster01-01:e0e local-only intercluster01 Failover Targets: cluster01-01:e0e, cluster01-01:e0f cluster01_icl02 cluster01-02:e0e local-only intercluster01 Failover Targets: cluster01-02:e0e, cluster01-02:e0f

データネットワークと共有するポートにクラスタ間 LIF を設定できます。これにより、クラスタ間ネットワークに必要なポート数を減らすことができます。

-

クラスタ内のポートの一覧を表示します。

「 network port show 」のように表示されます

コマンド構文の詳細については、"ONTAPコマンド リファレンス"を参照してください。

次の例は、「 cluster01 」内のネットワークポートを示しています。

cluster01::> network port show Speed (Mbps) Node Port IPspace Broadcast Domain Link MTU Admin/Oper ------ --------- ------------ ---------------- ----- ------- ------------ cluster01-01 e0a Cluster Cluster up 1500 auto/1000 e0b Cluster Cluster up 1500 auto/1000 e0c Default Default up 1500 auto/1000 e0d Default Default up 1500 auto/1000 cluster01-02 e0a Cluster Cluster up 1500 auto/1000 e0b Cluster Cluster up 1500 auto/1000 e0c Default Default up 1500 auto/1000 e0d Default Default up 1500 auto/1000 -

システム SVM にクラスタ間 LIF を作成します。

network interface create -vserver <system_svm> -lif <lif_name> -service-policy default-intercluster -home-node <node_name> -home-port <port_name> -address <port_ip_address> -netmask <netmask>次の例は、クラスタ間 LIF 「 cluster01_icl01 」と「 cluster01_icl02 」を作成します。

cluster01::> network interface create -vserver cluster01 -lif cluster01_icl01 -service- policy default-intercluster -home-node cluster01-01 -home-port e0c -address 192.168.1.201 -netmask 255.255.255.0 cluster01::> network interface create -vserver cluster01 -lif cluster01_icl02 -service- policy default-intercluster -home-node cluster01-02 -home-port e0c -address 192.168.1.202 -netmask 255.255.255.0

-

クラスタ間 LIF が作成されたことを確認します。

「 network interface show -service -policy default -intercluster 」のように表示されます

次のような出力が表示されます。

cluster01::> network interface show -service-policy default-intercluster Logical Status Network Current Current Is Vserver Interface Admin/Oper Address/Mask Node Port Home ----------- ---------- ---------- ------------------ ------------- ------- ---- cluster01 cluster01_icl01 up/up 192.168.1.201/24 cluster01-01 e0c true cluster01_icl02 up/up 192.168.1.202/24 cluster01-02 e0c true -

クラスタ間 LIF が冗長構成になっていることを確認します。

「 network interface show -service -policy default -intercluster-failover 」のように入力します

次の例は、「 e0c 」ポート上のクラスタ間 LIF 「 cluster01_icl01 」と「 cluster01_icl02 」が「 e0d 」ポートにフェイルオーバーされることを示しています。

cluster01::> network interface show -service-policy default-intercluster -failover Logical Home Failover Failover Vserver Interface Node:Port Policy Group -------- --------------- --------------------- --------------- -------- cluster01 cluster01_icl01 cluster01-01:e0c local-only Default Failover Targets: cluster01-01:e0c, cluster01-01:e0d cluster01_icl02 cluster01-02:e0c local-only Default Failover Targets: cluster01-02:e0c, cluster01-02:e0d

MetroClusterインターフェイスを作成し、ルートアグリゲートをミラーリングします

新しいMetroCluster IPノードにMetroClusterインターフェイスを作成し、ルートアグリゲートをミラーリングする必要があります。

-

この例で使用しているホームポートはプラットフォーム固有です。MetroCluster IPノードプラットフォームに固有のホームポートを使用する必要があります。

-

このタスクを実行する前に、の情報を確認してください 新しいDRグループを追加する際のVLANに関する考慮事項 。

-

各サイトで、新しいインタークラスター LIF をピア関係に追加します。

cluster_A から、以下のコマンドを実行します:

cluster peer modify -cluster cluster_B -peer-addrs <node_B_1-old IC port_ip_address>,<node_B_2-old IC port_ip_address>,<node_B_1-new IC port_ip_address>,<node_B_2-new IC port_ip_address>cluster_B から、次のコマンドを実行します:

cluster peer modify -cluster cluster_A -peer-addrs <node_A_1-old IC port_ip_address>,<node_A_2-old IC port_ip_address>,<node_A_1-new IC port_ip_address>,<node_A_2-new IC port_ip_address> -

各サイトで、クラスタピアリングが設定されていることを確認します。

cluster peer show

次の例は、 cluster_A のクラスタピアリング設定を示しています。

cluster_A:> cluster peer show Peer Cluster Name Cluster Serial Number Availability Authentication ------------------------- --------------------- -------------- -------------- cluster_B 1-80-000011 Available ok cluster_A::>

次の例は、 cluster_B でのクラスタピアリング設定を示しています。

cluster_B:> cluster peer show Peer Cluster Name Cluster Serial Number Availability Authentication ------------------------- --------------------- -------------- -------------- cluster_A 1-80-000011 Available ok cluster_B::>

-

MetroCluster IP ノードの DR グループを作成します。

MetroCluster 構成設定 dr-group create -partner-cluster

MetroCluster の設定と接続の詳細については、次のトピックを参照してください。

cluster_A::> metrocluster configuration-settings dr-group create -partner-cluster cluster_B -local-node node_A_1-new -remote-node node_B_1-new [Job 259] Job succeeded: DR Group Create is successful. cluster_A::>

-

DR グループが作成されたことを確認します。

「 MetroCluster configurion-settings dr-group show 」を参照してください

cluster_A::> metrocluster configuration-settings dr-group show DR Group ID Cluster Node DR Partner Node ----------- -------------------------- ------------------ ------------------ 1 cluster_A node_A_1-old node_B_1-old node_A_2-old node_B_2-old cluster_B node_B_1-old node_A_1-old node_B_2-old node_A_2-old 2 cluster_A node_A_1-new node_B_1-new node_A_2-new node_B_2-new cluster_B node_B_1-new node_A_1-new node_B_2-new node_A_2-new 8 entries were displayed. cluster_A::> -

新しく参加した MetroCluster IP ノードの MetroCluster IP インターフェイスを設定します。

-

MetroCluster IPインターフェイスを作成するときは、同じ範囲のシステム自動生成インターフェイスIPアドレスとの競合を避けるため、169.254.17.xまたは169.254.18.xのIPアドレスを使用しないでください。

-

サポートされている場合は、コマンドのパラメータを使用して、100より大きい別の(デフォルト以外の)VLAN(101~4095)を指定できます

-vlan-idmetrocluster configuration-settings interface create。サポートされるプラットフォームの情報については、を参照してください 新しいDRグループを追加する際のVLANに関する考慮事項 。 -

どちらのクラスタからも MetroCluster IP インターフェイスを設定できます。

MetroCluster 構成設定インターフェイス create-cluster-name

cluster_A::> metrocluster configuration-settings interface create -cluster-name cluster_A -home-node node_A_1-new -home-port e1a -address 172.17.26.10 -netmask 255.255.255.0 [Job 260] Job succeeded: Interface Create is successful. cluster_A::> metrocluster configuration-settings interface create -cluster-name cluster_A -home-node node_A_1-new -home-port e1b -address 172.17.27.10 -netmask 255.255.255.0 [Job 261] Job succeeded: Interface Create is successful. cluster_A::> metrocluster configuration-settings interface create -cluster-name cluster_A -home-node node_A_2-new -home-port e1a -address 172.17.26.11 -netmask 255.255.255.0 [Job 262] Job succeeded: Interface Create is successful. cluster_A::> :metrocluster configuration-settings interface create -cluster-name cluster_A -home-node node_A_2-new -home-port e1b -address 172.17.27.11 -netmask 255.255.255.0 [Job 263] Job succeeded: Interface Create is successful. cluster_A::> metrocluster configuration-settings interface create -cluster-name cluster_B -home-node node_B_1-new -home-port e1a -address 172.17.26.12 -netmask 255.255.255.0 [Job 264] Job succeeded: Interface Create is successful. cluster_A::> metrocluster configuration-settings interface create -cluster-name cluster_B -home-node node_B_1-new -home-port e1b -address 172.17.27.12 -netmask 255.255.255.0 [Job 265] Job succeeded: Interface Create is successful. cluster_A::> metrocluster configuration-settings interface create -cluster-name cluster_B -home-node node_B_2-new -home-port e1a -address 172.17.26.13 -netmask 255.255.255.0 [Job 266] Job succeeded: Interface Create is successful. cluster_A::> metrocluster configuration-settings interface create -cluster-name cluster_B -home-node node_B_2-new -home-port e1b -address 172.17.27.13 -netmask 255.255.255.0 [Job 267] Job succeeded: Interface Create is successful.

-

-

MetroCluster IP インターフェイスが作成されたことを確認します。

「 MetroCluster configurion-settings interface show 」を参照してください

cluster_A::>metrocluster configuration-settings interface show DR Config Group Cluster Node Network Address Netmask Gateway State ----- ------- ------- --------------- --------------- --------------- --------- 1 cluster_A node_A_1-old Home Port: e1a 172.17.26.10 255.255.255.0 - completed Home Port: e1b 172.17.27.10 255.255.255.0 - completed node_A_2-old Home Port: e1a 172.17.26.11 255.255.255.0 - completed Home Port: e1b 172.17.27.11 255.255.255.0 - completed cluster_B node_B_1-old Home Port: e1a 172.17.26.13 255.255.255.0 - completed Home Port: e1b 172.17.27.13 255.255.255.0 - completed node_B_1-old Home Port: e1a 172.17.26.12 255.255.255.0 - completed Home Port: e1b 172.17.27.12 255.255.255.0 - completed 2 cluster_A node_A_3-new Home Port: e1a 172.17.28.10 255.255.255.0 - completed Home Port: e1b 172.17.29.10 255.255.255.0 - completed node_A_3-new Home Port: e1a 172.17.28.11 255.255.255.0 - completed Home Port: e1b 172.17.29.11 255.255.255.0 - completed cluster_B node_B_3-new Home Port: e1a 172.17.28.13 255.255.255.0 - completed Home Port: e1b 172.17.29.13 255.255.255.0 - completed node_B_3-new Home Port: e1a 172.17.28.12 255.255.255.0 - completed Home Port: e1b 172.17.29.12 255.255.255.0 - completed 8 entries were displayed. cluster_A> -

MetroCluster IP インターフェイスを接続します。

MetroCluster 構成設定接続接続

このコマンドの実行には数分かかることがあります。 cluster_A::> metrocluster configuration-settings connection connect cluster_A::>

-

接続が正しく確立されていることを確認します MetroCluster configurion-settings connection show

cluster_A::> metrocluster configuration-settings connection show DR Source Destination Group Cluster Node Network Address Network Address Partner Type Config State ----- ------- ------- --------------- --------------- ------------ ------------ 1 cluster_A node_A_1-old Home Port: e1a 172.17.28.10 172.17.28.11 HA Partner completed Home Port: e1a 172.17.28.10 172.17.28.12 DR Partner completed Home Port: e1a 172.17.28.10 172.17.28.13 DR Auxiliary completed Home Port: e1b 172.17.29.10 172.17.29.11 HA Partner completed Home Port: e1b 172.17.29.10 172.17.29.12 DR Partner completed Home Port: e1b 172.17.29.10 172.17.29.13 DR Auxiliary completed node_A_2-old Home Port: e1a 172.17.28.11 172.17.28.10 HA Partner completed Home Port: e1a 172.17.28.11 172.17.28.13 DR Partner completed Home Port: e1a 172.17.28.11 172.17.28.12 DR Auxiliary completed Home Port: e1b 172.17.29.11 172.17.29.10 HA Partner completed Home Port: e1b 172.17.29.11 172.17.29.13 DR Partner completed Home Port: e1b 172.17.29.11 172.17.29.12 DR Auxiliary completed DR Source Destination Group Cluster Node Network Address Network Address Partner Type Config State ----- ------- ------- --------------- --------------- ------------ ------------ 1 cluster_B node_B_2-old Home Port: e1a 172.17.28.13 172.17.28.12 HA Partner completed Home Port: e1a 172.17.28.13 172.17.28.11 DR Partner completed Home Port: e1a 172.17.28.13 172.17.28.10 DR Auxiliary completed Home Port: e1b 172.17.29.13 172.17.29.12 HA Partner completed Home Port: e1b 172.17.29.13 172.17.29.11 DR Partner completed Home Port: e1b 172.17.29.13 172.17.29.10 DR Auxiliary completed node_B_1-old Home Port: e1a 172.17.28.12 172.17.28.13 HA Partner completed Home Port: e1a 172.17.28.12 172.17.28.10 DR Partner completed Home Port: e1a 172.17.28.12 172.17.28.11 DR Auxiliary completed Home Port: e1b 172.17.29.12 172.17.29.13 HA Partner completed Home Port: e1b 172.17.29.12 172.17.29.10 DR Partner completed Home Port: e1b 172.17.29.12 172.17.29.11 DR Auxiliary completed DR Source Destination Group Cluster Node Network Address Network Address Partner Type Config State ----- ------- ------- --------------- --------------- ------------ ------------ 2 cluster_A node_A_1-new** Home Port: e1a 172.17.26.10 172.17.26.11 HA Partner completed Home Port: e1a 172.17.26.10 172.17.26.12 DR Partner completed Home Port: e1a 172.17.26.10 172.17.26.13 DR Auxiliary completed Home Port: e1b 172.17.27.10 172.17.27.11 HA Partner completed Home Port: e1b 172.17.27.10 172.17.27.12 DR Partner completed Home Port: e1b 172.17.27.10 172.17.27.13 DR Auxiliary completed node_A_2-new Home Port: e1a 172.17.26.11 172.17.26.10 HA Partner completed Home Port: e1a 172.17.26.11 172.17.26.13 DR Partner completed Home Port: e1a 172.17.26.11 172.17.26.12 DR Auxiliary completed Home Port: e1b 172.17.27.11 172.17.27.10 HA Partner completed Home Port: e1b 172.17.27.11 172.17.27.13 DR Partner completed Home Port: e1b 172.17.27.11 172.17.27.12 DR Auxiliary completed DR Source Destination Group Cluster Node Network Address Network Address Partner Type Config State ----- ------- ------- --------------- --------------- ------------ ------------ 2 cluster_B node_B_2-new Home Port: e1a 172.17.26.13 172.17.26.12 HA Partner completed Home Port: e1a 172.17.26.13 172.17.26.11 DR Partner completed Home Port: e1a 172.17.26.13 172.17.26.10 DR Auxiliary completed Home Port: e1b 172.17.27.13 172.17.27.12 HA Partner completed Home Port: e1b 172.17.27.13 172.17.27.11 DR Partner completed Home Port: e1b 172.17.27.13 172.17.27.10 DR Auxiliary completed node_B_1-new Home Port: e1a 172.17.26.12 172.17.26.13 HA Partner completed Home Port: e1a 172.17.26.12 172.17.26.10 DR Partner completed Home Port: e1a 172.17.26.12 172.17.26.11 DR Auxiliary completed Home Port: e1b 172.17.27.12 172.17.27.13 HA Partner completed Home Port: e1b 172.17.27.12 172.17.27.10 DR Partner completed Home Port: e1b 172.17.27.12 172.17.27.11 DR Auxiliary completed 48 entries were displayed. cluster_A::> -

ディスクの自動割り当てとパーティショニングを確認します。

「 Disk show -pool Pool1 」

cluster_A::> disk show -pool Pool1 Usable Disk Container Container Disk Size Shelf Bay Type Type Name Owner ---------------- ---------- ----- --- ------- ----------- --------- -------- 1.10.4 - 10 4 SAS remote - node_B_2 1.10.13 - 10 13 SAS remote - node_B_2 1.10.14 - 10 14 SAS remote - node_B_1 1.10.15 - 10 15 SAS remote - node_B_1 1.10.16 - 10 16 SAS remote - node_B_1 1.10.18 - 10 18 SAS remote - node_B_2 ... 2.20.0 546.9GB 20 0 SAS aggregate aggr0_rha1_a1 node_a_1 2.20.3 546.9GB 20 3 SAS aggregate aggr0_rha1_a2 node_a_2 2.20.5 546.9GB 20 5 SAS aggregate rha1_a1_aggr1 node_a_1 2.20.6 546.9GB 20 6 SAS aggregate rha1_a1_aggr1 node_a_1 2.20.7 546.9GB 20 7 SAS aggregate rha1_a2_aggr1 node_a_2 2.20.10 546.9GB 20 10 SAS aggregate rha1_a1_aggr1 node_a_1 ... 43 entries were displayed. cluster_A::> -

ルートアグリゲートをミラーします。

「 storage aggregate mirror -aggregate aggr0_cluster1_01 -new 」という名前のアグリゲートが作成されます

この手順は MetroCluster IP ノードごとに実行する必要があります。 cluster_A::> aggr mirror -aggregate aggr0_node_A_1-new Info: Disks would be added to aggregate "aggr0_node_A_1-new"on node "node_A_1-new" in the following manner: Second Plex RAID Group rg0, 3 disks (block checksum, raid_dp) Usable Physical Position Disk Type Size Size ---------- ------------------------- ---------- -------- -------- dparity 4.20.0 SAS - - parity 4.20.3 SAS - - data 4.20.1 SAS 546.9GB 558.9GB Aggregate capacity available forvolume use would be 467.6GB. Do you want to continue? {y|n}: y cluster_A::> -

ルートアグリゲートがミラーされたことを確認します。

「 storage aggregate show

cluster_A::> aggr show Aggregate Size Available Used% State #Vols Nodes RAID Status --------- -------- --------- ----- ------- ------ ---------------- ------------ aggr0_node_A_1-old 349.0GB 16.84GB 95% online 1 node_A_1-old raid_dp, mirrored, normal aggr0_node_A_2-old 349.0GB 16.84GB 95% online 1 node_A_2-old raid_dp, mirrored, normal aggr0_node_A_1-new 467.6GB 22.63GB 95% online 1 node_A_1-new raid_dp, mirrored, normal aggr0_node_A_2-new 467.6GB 22.62GB 95% online 1 node_A_2-new raid_dp, mirrored, normal aggr_data_a1 1.02TB 1.01TB 1% online 1 node_A_1-old raid_dp, mirrored, normal aggr_data_a2 1.02TB 1.01TB 1% online 1 node_A_2-old raid_dp, mirrored,

新しいノードの追加完了

新しい DR グループを MetroCluster 構成に組み込み、新しいノードにミラーされたデータアグリゲートを作成する必要があります。

-

MetroCluster 構成を更新します。

-

advanced 権限モードに切り替えます。

「 advanced 」の権限が必要です

-

新しく追加されたノードのいずれかでMetroCluster構成を更新します。

MetroCluster 構成の内容

操作

複数のデータアグリゲート

いずれかのノードのプロンプトで、次のコマンドを実行します。

metrocluster configure <node-name>ミラーされた1つのデータアグリゲートを一方または両方のサイトに配置

いずれかのノードのプロンプトで、 `-allow-with-one-aggregate true`パラメータを使用してMetroClusterを設定します。

metrocluster configure -allow-with-one-aggregate true <node-name> -

新しい各ノードをリブートします。

node reboot -node <node_name> -inhibit-takeover true

ノードを特定の順序でリブートする必要はありませんが、1つのノードが完全にブートしてすべての接続が確立されるまで待ってから、次のノードをリブートしてください。 -

admin 権限モードに戻ります。

「特権管理者」

-

-

新しい MetroCluster ノードのそれぞれで、ミラーされたデータアグリゲートを作成します。

storage aggregate create -aggregate <aggregate-name> -node <node-name> -diskcount <no-of-disks> -mirror true-

ミラーされたデータアグリゲートをサイトごとに少なくとも1つ作成する必要があります。MDVボリュームをホストするために、サイトごとに2つのミラーされたデータアグリゲートをMetroCluster IPノード上に配置することを推奨しますが、サイトごとに1つのアグリゲートがサポートされます(ただし推奨されません)。MetroClusterの一方のサイトにミラーされたデータアグリゲートが1つあり、もう一方のサイトに複数のミラーされたデータアグリゲートがあります。

-

アグリゲート名は、MetroClusterサイト全体で一意である必要があります。つまり、サイト A とサイト B に同じ名前を持つ 2 つの異なるデータ アグリゲートを持つことはできません。

次の例は、 node_A_1 で新しいアグリゲートを作成します。

cluster_A::> storage aggregate create -aggregate data_a3 -node node_A_1-new -diskcount 10 -mirror t Info: The layout for aggregate "data_a3" on node "node_A_1-new" would be: First Plex RAID Group rg0, 5 disks (block checksum, raid_dp) Usable Physical Position Disk Type Size Size ---------- ------------------------- ---------- -------- -------- dparity 5.10.15 SAS - - parity 5.10.16 SAS - - data 5.10.17 SAS 546.9GB 547.1GB data 5.10.18 SAS 546.9GB 558.9GB data 5.10.19 SAS 546.9GB 558.9GB Second Plex RAID Group rg0, 5 disks (block checksum, raid_dp) Usable Physical Position Disk Type Size Size ---------- ------------------------- ---------- -------- -------- dparity 4.20.17 SAS - - parity 4.20.14 SAS - - data 4.20.18 SAS 546.9GB 547.1GB data 4.20.19 SAS 546.9GB 547.1GB data 4.20.16 SAS 546.9GB 547.1GB Aggregate capacity available for volume use would be 1.37TB. Do you want to continue? {y|n}: y [Job 440] Job succeeded: DONE cluster_A::> -

-

ノードが DR グループに追加されたことを確認します。

cluster_A::*> metrocluster node show DR Configuration DR Group Cluster Node State Mirroring Mode ----- ------- ------------------ -------------- --------- -------------------- 1 cluster_A node_A_1-old configured enabled normal node_A_2-old configured enabled normal cluster_B node_B_1-old configured enabled normal node_B_2-old configured enabled normal 2 cluster_A node_A_3-new configured enabled normal node_A_4-new configured enabled normal cluster_B node_B_3-new configured enabled normal node_B_4-new configured enabled normal 8 entries were displayed. cluster_A::*> -

MDV_CRSボリュームをadvanced権限モードで移動します。

-

ボリュームを表示して MDV ボリュームを特定します。

各サイトにミラーされたデータアグリゲートが 1 つある場合、両方の MDV ボリュームをこの 1 つのアグリゲートに移動します。ミラーされたデータアグリゲートが 2 つ以上ある場合、各 MDV ボリュームを別々のアグリゲートに移動します。

4ノードMetroCluster構成を永続的な8ノード構成に拡張する場合は、MDVボリュームの1つを新しいDRグループに移動する必要があります。

次に 'volume show 出力の MDV ボリュームの例を示します

cluster_A::> volume show Vserver Volume Aggregate State Type Size Available Used% --------- ------------ ------------ ---------- ---- ---------- ---------- ----- ... cluster_A MDV_CRS_2c78e009ff5611e9b0f300a0985ef8c4_A aggr_b1 - RW - - - cluster_A MDV_CRS_2c78e009ff5611e9b0f300a0985ef8c4_B aggr_b2 - RW - - - cluster_A MDV_CRS_d6b0b313ff5611e9837100a098544e51_A aggr_a1 online RW 10GB 9.50GB 0% cluster_A MDV_CRS_d6b0b313ff5611e9837100a098544e51_B aggr_a2 online RW 10GB 9.50GB 0% ... 11 entries were displayed.mple -

advanced 権限レベルを設定します。

「 advanced 」の権限が必要です

-

MDV ボリュームを 1 つずつ移動します。

volume move start -volume <mdv-volume> -destination-aggregate <aggr-on-new-node> -vserver <svm-name>次の例は、「 MDV_CRS_d6b0b313ff5611e9837100a098544e51_a 」を「 node_A_1 」のアグリゲート「 node_A_1 」に移動するコマンドと出力を示しています。

cluster_A::*> vol move start -volume MDV_CRS_d6b0b313ff5611e9837100a098544e51_A -destination-aggregate data_a3 -vserver cluster_A Warning: You are about to modify the system volume "MDV_CRS_d6b0b313ff5611e9837100a098544e51_A". This might cause severe performance or stability problems. Do not proceed unless directed to do so by support. Do you want to proceed? {y|n}: y [Job 494] Job is queued: Move "MDV_CRS_d6b0b313ff5611e9837100a098544e51_A" in Vserver "cluster_A" to aggregate "data_a3". Use the "volume move show -vserver cluster_A -volume MDV_CRS_d6b0b313ff5611e9837100a098544e51_A" command to view the status of this operation. -

volume show コマンドを使用して、 MDV ボリュームが正常に移動されたことを確認します。

volume show <mdv-name>次の出力は、 MDV ボリュームが移動されたことを示しています。

cluster_A::*> vol show MDV_CRS_d6b0b313ff5611e9837100a098544e51_B Vserver Volume Aggregate State Type Size Available Used% --------- ------------ ------------ ---------- ---- ---------- ---------- ----- cluster_A MDV_CRS_d6b0b313ff5611e9837100a098544e51_B aggr_a2 online RW 10GB 9.50GB 0% -

-

古いノードから新しいノードにイプシロンを移動します。

-

現在イプシロンが設定されているノードを特定します。

cluster show -fields epsilon

cluster_B::*> cluster show -fields epsilon node epsilon ---------------- ------- node_A_1-old true node_A_2-old false node_A_3-new false node_A_4-new false 4 entries were displayed.

-

古いノード( node_A_1 古い)でイプシロンを false に設定します。

cluster modify -node <old-node> -epsilon false* -

新しいノード( node_A_1 )でイプシロンを true に設定します。

cluster modify -node <new-node> -epsilon true -

イプシロンが正しいノードに移動されたことを確認します。

cluster show -fields epsilon

cluster_A::*> cluster show -fields epsilon node epsilon ---------------- ------- node_A_1-old false node_A_2-old false node_A_3-new true node_A_4-new false 4 entries were displayed.

-

-

システムでエンドツーエンドの暗号化がサポートされている場合は、次の操作を実行できます。 "エンドツーエンドの暗号化を実現" 新しいDRグループ。